Gemma 4 가이드

Gemma 4 GGUF 다운로드 가이드: 안전한 소스, 양자화 팁 및 로컬 설정

Gemma 4 GGUF 다운로드를 찾고 계시다면, 이미 "이 모델이 무엇인가"라는 단계는 지나셨을 것입니다. 시간 낭비 없이 Gemma 4를 가장 안전하게 다운로드하고, 사용 중인 기기에 맞는 양자화 버전을 골라 로컬에서 구동하는 것이 현재의 목표일 것입니다.

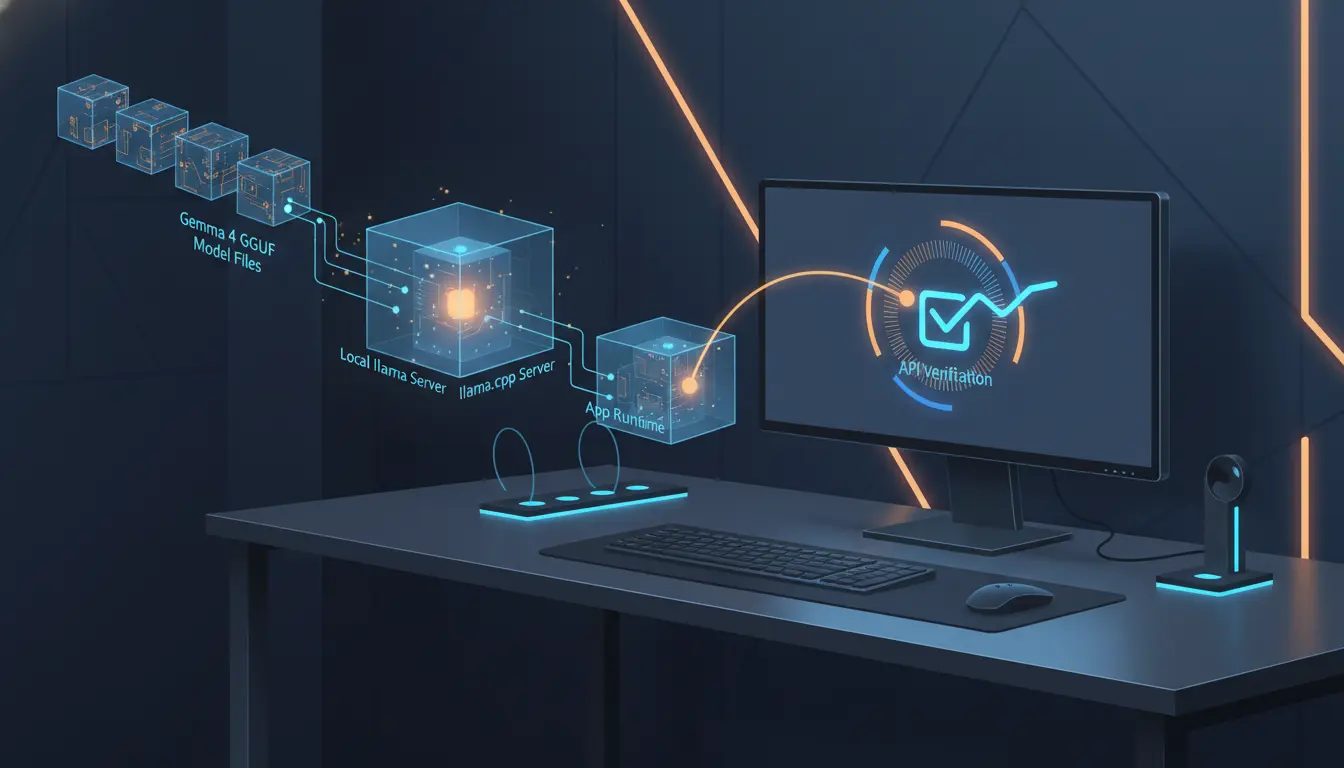

이 가이드는 바로 그 목적을 위해 제작되었습니다. 신뢰할 수 있는 소스, Gemma 4 Hugging Face 리포지토리 활용법, llama.cpp에서 GGUF 빌드를 실행하는 방법, 그리고 더 간단한 Ollama 경로에 대해 다룹니다.

Gemma 4 GGUF 다운로드: 가장 큰 파일이 아닌 가장 적합한 파일로 시작하기

GGUF 워크플로우에서 가장 큰 실수는 파일 크기가 클수록 무조건 성능이 좋을 것이라고 가정하는 것입니다.

Gemma 4를 다운로드하기 전에, 본인의 하드웨어에서 실제로 돌아갈 수 있는 모델이 무엇인지 결정하세요:

- E2B: 가장 가벼운 입문용 모델이 필요한 경우

- E4B: 균형 잡힌 첫 로컬 실행을 원하는 경우

- 26B A4B: 효율성을 챙기면서도 더 강력한 출력을 원하는 경우

- 31B: 최고 사양의 dense 모델을 원하는 경우

그다음, 메모리 사양에 맞춰 양자화 버전을 선택하세요. GGUF 경로는 선택한 파일이 본인의 하드웨어에서 쾌적하게 돌아갈 때만 의미가 있습니다.

모델 선택에 도움이 더 필요하다면 Gemma 4란 무엇인가요? 가이드를 먼저 확인하세요.

Gemma 4 GGUF란 무엇인가요?

Gemma 4 GGUF 설정은 효율적인 로컬 추론과 메타데이터 기반 패키징을 위해 설계된 llama.cpp 친화적인 이진 모델 형식입니다.

실질적으로 Gemma 4 GGUF 포맷은 다음이 필요한 로컬 사용자들에게 가장 중요합니다:

- llama.cpp 호환성

- 제한된 메모리 예산에 최적화된 양자화 파일

- 로컬 CLI(커맨드 라인) 또는 로컬 서버 배포를 위한 직접적인 경로

많은 로컬 개발자들에게 Gemma 4 GGUF는 모델 배포와 실제 사용 가능한 자가 호스팅 워크플로우 사이를 이어주는 가장 실질적인 가교 역할을 합니다.

로컬 제어권 확보가 목표라면 GGUF 방식이 가장 빠른 지름길인 경우가 많습니다.

신뢰할 수 있는 Gemma 4 GGUF 다운로드 소스

모든 GGUF 소스가 동일한 신뢰도를 갖는 것은 아닙니다.

다음은 권장하는 소스 계층 구조입니다:

| 소스 | 제공 내용 | 권장 용도 |

|---|---|---|

| Hugging Face의 ggml-org | llama.cpp 사용에 맞춘 공식 스타일 GGUF 리포지토리 | llama.cpp 사용자에게 가장 추천하는 첫 번째 경로 |

| Ollama 라이브러리 | 관리형 Gemma 4 빌드 로컬 설치 | 단순한 사용을 원하는 사용자에게 가장 추천하는 첫 번째 경로 |

| Hugging Face의 bartowski | 수많은 커뮤니티 양자화 GGUF 파일 | 더 다양한 양자화 선택지가 필요할 때 |

| 공식 Google / Kaggle 가중치 | Safetensors 및 공식 배포 컨텍스트 | 직접적인 GGUF 사용보다는 출처 확인을 위해 권장 |

출처의 투명성이 가장 중요하다면 Google 공식 Gemma 4 채널에서 시작하여 신뢰할 수 있는 llama.cpp 생태계로 이동하세요. 편의성이 주안점이라면 수동 Gemma 4 다운로드보다는 Ollama가 더 나은 해답이 될 것입니다.

Gemma 4 Hugging Face 선택지

수많은 사용자에게 가장 실질적인 GGUF 경로는 Gemma 4 Hugging Face 리포지토리에서 시작됩니다.

보통 두 가지 Hugging Face 경로가 있습니다:

- 더 직접적인 llama.cpp 친화적 GGUF 경로를 위해 ggml-org 리포지토리 사용

Q4_K_M과 같은 특정 양자화 파일이 필요할 때 bartowski와 같은 커뮤니티 리포지토리 사용

이것이 로컬 설정에서 Gemma 4 Hugging Face라는 키워드가 중요한 이유입니다. 단순한 브라우징을 넘어 공식 스타일의 호환성을 따를지, 아니면 더 폭넓은 커뮤니티 옵션을 택할지 결정하는 곳이기 때문입니다.

llama.cpp를 이용한 가장 빠른 Gemma 4 GGUF 실행 경로

llama.cpp에서 가장 빠른 방법은 직접 -hf 모드를 사용하는 것입니다.

먼저 llama.cpp를 설치합니다:

brew install llama.cpp

Windows의 경우:

winget install llama.cpp

그 후 설치를 확인합니다:

llama-cli --version

llama-server --version

이제 서버 스타일의 간단한 GGUF 워크플로우를 실행합니다:

llama-server -hf ggml-org/gemma-4-26B-A4B-it-GGUF

이 명령어 하나로 llama.cpp가 Gemma 4 다운로드와 로컬 캐싱을 자동으로 처리합니다. OpenAI 호환 로컬 엔드포인트를 원하신다면 이 방법이 가장 매끄러운 경로입니다.

Hugging Face CLI를 이용한 수동 Gemma 4 다운로드

자동 다운로드 대신 특정 파일을 명시적으로 관리하고 싶은 사용자가 있을 수 있습니다.

그런 경우에는 다음과 같은 수동 Gemma 4 다운로드 명령어가 도움을 줍니다:

pip install -U "huggingface_hub[cli]"

huggingface-cli download bartowski/google_gemma-4-31B-it-GGUF \

--include "google_gemma-4-31B-it-Q4_K_M.gguf" \

--local-dir ./

다운로드 후 로컬에서 실행합니다:

llama-cli -m ./google_gemma-4-31B-it-Q4_K_M.gguf -p "In one sentence, what is Gemma 4?"

정확한 파일 이름, 양자화 선택, 또는 반복 가능한 배포 스크립트가 필요한 경우 이 설정 방식이 더 좋습니다.

수동 파일 관리를 원하지 않을 때 가장 쉬운 Gemma 4 다운로드 방법

모든 수동 GGUF 워크플로우가 초보자에게 적합한 것은 아닙니다.

단순하게 로컬 실행만 원한다면 Ollama를 사용하세요:

ollama --version

ollama pull gemma4

ollama list

ollama run gemma4 "Give me a one-line test."

본인의 사양에 맞춰 gemma4:e2b, gemma4:e4b, gemma4:26b, gemma4:31b와 같은 특정 태그를 사용하여 다운로드할 수도 있습니다.

Ollama가 로컬 모델의 수명 주기를 대신 관리해주기 때문에, 많은 사용자에게 이 방식이 수동 GGUF 워크플로우보다 더 나은 첫 번째 Gemma 4 다운로드 경로가 됩니다.

Gemma 4 GGUF 설정이 제대로 되었는지 확인하는 방법

GGUF 설정의 완성은 실제 구동을 확인했을 때입니다.

llama.cpp 서버 모드의 경우:

curl http://localhost:8080/v1/chat/completions \

-H "Content-Type: application/json" \

-H "Authorization: Bearer no-key" \

-d '{

"messages": [

{"role": "system", "content": "You are a helpful assistant."},

{"role": "user", "content": "In one sentence: what is Gemma 4?"}

]

}'

Ollama의 경우:

curl http://localhost:11434/api/generate -d '{

"model": "gemma4",

"prompt": "Give a one-line test output."

}'

파일 로딩과 실제 프롬프트 응답까지 모두 통과했다면, 이제 실제 작업 테스트 단계로 넘어갈 준비가 된 것입니다.

일반적인 Gemma 4 GGUF 문제점

출시 초기 사용자들이 실제로 마주하게 되는 문제점들을 미리 알려 드립니다.

문제 1: 모델 로드가 잘 안 되거나 GUI에서 실패함

새 모델 출시 직후에는 일부 GUI 도구들이 llama.cpp 지원 속도를 따라가지 못할 수 있습니다. 특정 앱에서 GGUF 빌드가 작동하지 않는다면, 파일 자체의 결함으로 판단하기 전에 최신 버전의 llama.cpp에서 동일한 모델을 테스트해 보세요.

문제 2: 메모리 부족 (Out-of-memory) 오류

GGUF 빌드가 로드되다가 충돌하거나 제대로 실행되지 않는다면, 보통 다음 중 하나가 해결책입니다:

- 더 작은 양자화 버전 선택

- 더 작은 모델 변체 선택

- 컨텍스트(context) 사용량 줄이기

- 31B 모델이 무조건 첫 번째 테스트 대상이어야 한다는 생각 버리기

문제 3: 모달리티(Modality) 불일치

문서상으로는 오디오를 지원한다고 되어 있어도, 로컬 도구들의 지원이 아직 미비할 수 있습니다. GGUF 파일이 모든 런타임에서 멀티모달 기능을 당장 첫날부터 제공한다고 보장하지는 않습니다.

Gemma 4 GGUF 설정 이후 단계

GGUF 설정이 완료되었다면 다음 가이드들을 확인해 보세요:

최종 권장 사항

이 가이드의 최종 권장 사항은 간단합니다. 정밀한 제어를 원하신다면 ggml-org 또는 신뢰할 수 있는 Gemma 4 Hugging Face GGUF 소스를 llama.cpp와 함께 사용하세요. 편의성이 중요하다면 Ollama를 선택하세요. 그리고 성공률을 높이려면 본인이 생각하는 것보다 더 작은 모델부터 시작해 보세요.

성공적인 Gemma 4 GGUF 다운로드는 눈에 보이는 첫 번째 파일을 잡는 것이 아니라, 처음부터 본인에게 맞는 소스, 양자화 버전, 그리고 런타임을 선택하는 것입니다.

관련 가이드

지금 고민 중인 결정과 가장 잘 맞는 다음 가이드를 따라 Gemma 4 클러스터를 계속 탐색해 보세요.

llama.cpp에서 Gemma 4를 지원하나요? GGUF 현황, 수정 사항 및 작동 방식

llama.cpp가 Gemma 4를 지원하는지에 대한 답변과 함께, 공식 GGUF 링크, 현재 지원 상태 및 '지원됨'의 실제 의미를 설명하는 실전 가이드입니다.

llama.cpp로 Gemma 4 실행하는 방법: GGUF 설정, 하드웨어 및 양자화 가이드

Gemma 4를 llama.cpp와 함께 로컬에서 실행하는 데 필요한 모든 것: 하드웨어 표, 복사해서 사용하는 빌드 명령어, 양자화 가이드 및 멀티모달 설정.

Gemma 4 API 가이드: 로컬 OpenAI 호환 설정 방법

이 Gemma 4 API 가이드를 통해 로컬 OpenAI 호환 엔드포인트를 구축하고, 신속하게 테스트하며, 본인의 워크플로우에 맞는 최적의 런타임을 선택해 보세요.

다음에 무엇을 읽을지 아직 고민 중인가요?

가이드 허브로 돌아가 모델 비교, 설정 워크스루, 하드웨어 계획 페이지를 둘러보세요.