Gemma 4 指南

Gemma 4 GGUF 下载指南:可信来源、量化选择与本地运行

如果你现在要找 Gemma 4 GGUF download,说明你已经不是“先了解一下”的阶段了,而是想直接把模型下载到本地并跑起来。

这篇 Gemma 4 GGUF download 指南就是为这种需求写的:它会告诉你应该去哪里 download Gemma 4、怎么选量化、什么时候看 Gemma 4 Hugging Face、什么时候直接用 Ollama 更省事。

Gemma 4 GGUF download 之前,先选对模型

很多人做 Gemma 4 GGUF download 时,第一个动作就是点最大文件。这个动作通常不聪明。

在你真的 download Gemma 4 之前,先确认哪个版本适合你的机器:

- E2B:最低门槛

- E4B:最均衡的本地起点

- 26B A4B:更强输出和更高效率

- 31B:家族里的高质量路线

一条好的 Gemma 4 GGUF download 路线,不是先看哪个最强,而是先看哪个最适合你。

如果你还没想清楚,可以先看 What is Gemma 4?。

Gemma 4 GGUF 是什么

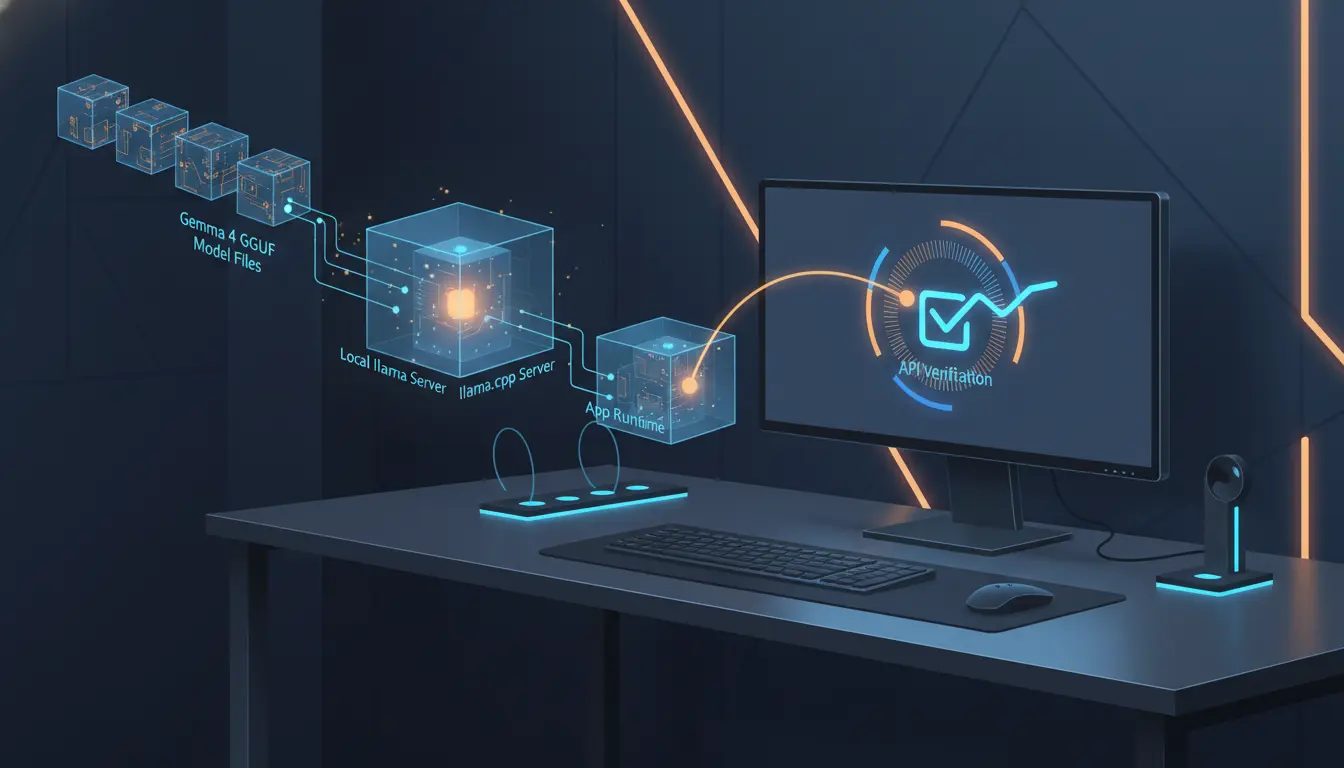

一条 Gemma 4 GGUF download 路线,本质上是在获取可被 llama.cpp 直接使用的量化模型文件。

换句话说,Gemma 4 GGUF 对本地用户的重要性在于:

- 它适合 llama.cpp

- 它更适合本地量化部署

- 它能更方便地走 CLI 或本地 server 路线

如果你的目标是本地控制权,那么 Gemma 4 GGUF download 往往就是最直接的入口。

哪些来源适合 Gemma 4 GGUF download

并不是所有 Gemma 4 GGUF download 来源都一样可靠。

最实用的选择方式是按这个顺序看:

| Source | What you get | Best use |

|---|---|---|

| ggml-org on Hugging Face | 更贴近 llama.cpp 的 GGUF 仓库 | 最适合 llama.cpp 用户 |

| Ollama library | 托管式本地模型安装 | 最适合想省心的人 |

| bartowski on Hugging Face | 更多量化文件选项 | 最适合需要特定 quant 的人 |

| Google / Kaggle 官方权重 | 更偏官方原始分发 | 适合校验来源,不是直接 GGUF 入口 |

所以,如果你担心来源可信度,Gemma 4 GGUF download 最好先从官方或强关联生态往下看;如果你只想快一点跑起来,很多时候直接用 Ollama 比手动 Gemma 4 download 更轻松。

Gemma 4 Hugging Face 路线怎么理解

对很多本地用户来说,真正可操作的 Gemma 4 GGUF download 起点就是 Gemma 4 Hugging Face。

常见有两条 Hugging Face 路线:

- 走 ggml-org,拿更贴近 llama.cpp 官方生态的 Gemma 4 GGUF download

- 走 bartowski 这类社区量化仓库,拿更明确的量化文件

这也是为什么 Gemma 4 Hugging Face 这个关键词搜索意图很强。因为用户不是单纯看页面,而是在判断该走“稳妥路线”还是“丰富量化路线”。

用 llama.cpp 做 Gemma 4 GGUF download 的最快方法

如果你想最快完成 Gemma 4 GGUF download,llama.cpp 的 -hf 模式通常最方便。

先安装 llama.cpp:

brew install llama.cpp

Windows 可以用:

winget install llama.cpp

然后验证:

llama-cli --version

llama-server --version

接着用最直接的 Gemma 4 GGUF download 方式运行:

llama-server -hf ggml-org/gemma-4-26B-A4B-it-GGUF

这个命令的好处是,llama.cpp 会自动处理 Gemma 4 download 和本地缓存。你不需要先手工找文件再手工搬路径。

手动 Gemma 4 download 的方式

如果你更喜欢可控、可复现的 Gemma 4 GGUF download,那就可以走 Hugging Face CLI。

pip install -U "huggingface_hub[cli]"

huggingface-cli download bartowski/google_gemma-4-31B-it-GGUF \

--include "google_gemma-4-31B-it-Q4_K_M.gguf" \

--local-dir ./

下载后运行:

llama-cli -m ./google_gemma-4-31B-it-Q4_K_M.gguf -p "In one sentence, what is Gemma 4?"

这种 Gemma 4 GGUF download 更适合在意文件名、量化版本、自动化脚本的人。

如果你不想手动处理文件

并不是每个人都一定需要完整的 Gemma 4 GGUF download 流程。

如果你只是想最快跑起来,Ollama 更适合:

ollama --version

ollama pull gemma4

ollama list

ollama run gemma4 "Give me a one-line test."

在很多情况下,这会比手动 Gemma 4 download 更友好,尤其适合第一次接触本地模型的人。

怎么确认你的 Gemma 4 GGUF download 成功了

一条 Gemma 4 GGUF download 只有在真正跑通后才算完成。

llama.cpp server 可以这样测:

curl http://localhost:8080/v1/chat/completions \

-H "Content-Type: application/json" \

-H "Authorization: Bearer no-key" \

-d '{

"messages": [

{"role": "system", "content": "You are a helpful assistant."},

{"role": "user", "content": "In one sentence: what is Gemma 4?"}

]

}'

Ollama 可以这样测:

curl http://localhost:11434/api/generate -d '{

"model": "gemma4",

"prompt": "Give a one-line test output."

}'

如果你的 Gemma 4 GGUF download 已经能成功返回内容,那说明下载、加载和最基础的推理链路都通了。

Gemma 4 GGUF download 常见问题

一篇有用的 Gemma 4 GGUF download 指南,必须把最常见的问题提前说清楚。

1. GUI 里加载失败

有些 GUI 工具在新模型发布初期会落后于 llama.cpp 支持。如果你的 Gemma 4 GGUF download 在某个 GUI 里打不开,先不要急着怀疑文件,先去最新版 llama.cpp 里验证。

2. 内存不够

如果 Gemma 4 GGUF download 完成了,但加载时报 OOM 或运行极慢,常见做法是:

- 降低 quant

- 换更小模型

- 降低上下文长度

- 不要默认第一次就上 31B

3. 模态支持和文档不一致

模型卡支持音频,不代表每个本地工具都第一时间支持。Gemma 4 GGUF download 成功,并不自动等于所有模态能力都已经在本地 runtime 里可用。

下载完成后看什么

完成 Gemma 4 GGUF download 后,推荐继续看这些文章:

最终建议

这篇 Gemma 4 GGUF download 的最终建议很简单:想要更强控制力,就优先走可信的 Gemma 4 Hugging Face GGUF 路线配合 llama.cpp;想要更轻松,就用 Ollama;想要最高成功率,就从比你直觉更小的模型开始。

一条成功的 Gemma 4 GGUF download 路线,不是随便下一个文件,而是从一开始就选对来源、量化和运行方式。

相关阅读

继续沿着 Gemma 4 内容集群往下读,选一个离你当前决策最近的下一篇。

还没决定下一篇看什么?

回到指南页,按模型对比、本地部署和硬件规划三个方向继续浏览。