Hướng dẫn Gemma 4

Hướng dẫn tải Gemma 4 GGUF: Nguồn an toàn, Mẹo Quant và Thiết lập cục bộ

Nếu bạn đang cần một bản tải Gemma 4 GGUF, bạn hẳn đã vượt qua giai đoạn "mô hình này là gì?". Bạn đang tìm kiếm cách an toàn nhất để tải về Gemma 4, chọn đúng mức lượng tử hóa (quant) và vận hành nó cục bộ mà không lãng phí hàng giờ đồng hồ.

Hướng dẫn này được xây dựng cho mục đích chính xác đó. Nó bao gồm các nguồn đáng tin cậy, khi nào nên sử dụng các repository Gemma 4 trên Hugging Face, cách chạy các bản build GGUF trong llama.cpp và khi nào thì Ollama là lộ trình đơn giản hơn.

Tải Gemma 4 GGUF: Bắt đầu với tệp tin đúng, không phải tệp tin lớn nhất

Sai lầm lớn nhất trong bất kỳ quy trình làm việc GGUF nào là mặc định cho rằng tệp tin lớn nhất là tệp tin tốt nhất.

Trước khi bạn tải về Gemma 4, hãy quyết định xem thành viên nào trong gia đình mô hình này thực sự phù hợp với máy của bạn:

- E2B nếu bạn cần một điểm bắt đầu nhẹ nhàng nhất.

- E4B nếu bạn muốn một lần chạy cục bộ đầu tiên cân bằng tốt nhất.

- 26B A4B nếu bạn muốn đầu ra mạnh mẽ và quan tâm đến hiệu quả.

- 31B nếu bạn muốn mô hình dense (dày đặc) cao cấp nhất.

Sau đó, hãy chọn mức quant dựa trên bộ nhớ. Lộ trình GGUF chỉ hữu ích nếu tệp tin bạn chọn có thể chạy thoải mái trên phần cứng của bạn.

Nếu bạn vẫn cần trợ giúp để chọn mô hình, hãy đọc Gemma 4 là gì? trước.

Gemma 4 GGUF là gì?

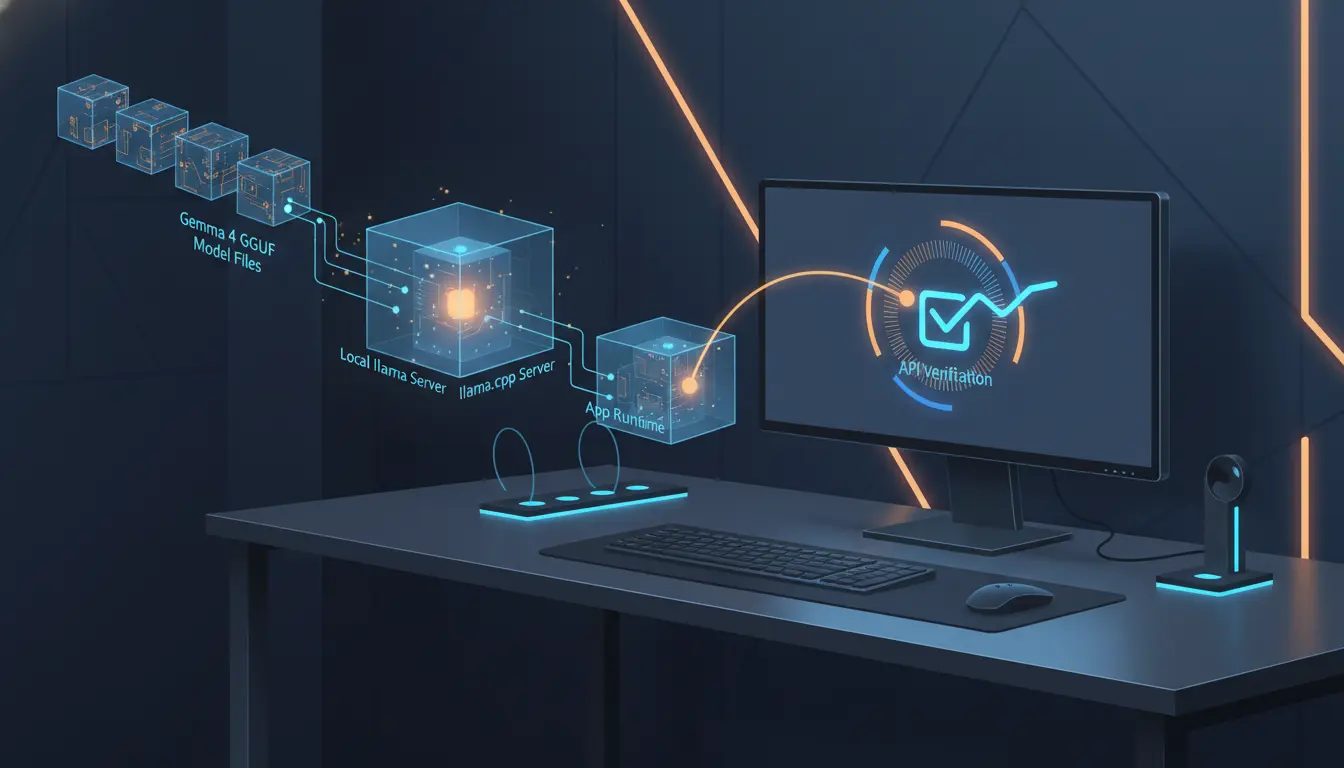

Thiết lập Gemma 4 GGUF mang lại cho bạn một định dạng mô hình nhị phân thân thiện với llama.cpp, được thiết kế để suy luận cục bộ hiệu quả và đóng gói có nhận biết siêu dữ liệu (metadata-aware).

Trong thực tế, Gemma 4 GGUF quan trọng vì đây là định dạng mà hầu hết người dùng cục bộ muốn khi họ cần:

- Khả năng tương thích với llama.cpp.

- Các tệp tin được lượng tử hóa (quantized) cho các ngân sách bộ nhớ nhỏ hơn.

- Một lộ trình trực tiếp đến việc triển khai CLI cục bộ hoặc máy chủ cục bộ.

Đối với nhiều người xây dựng hệ thống cục bộ, Gemma 4 GGUF là cây cầu thực tế nhất nối liền giữa tính khả dụng của mô hình và một quy trình làm việc tự host có thể sử dụng được.

Nếu mục tiêu của bạn là quyền kiểm soát cục bộ, lộ trình GGUF thường là con đường nhanh nhất.

Các nguồn đáng tin cậy để tải Gemma 4 GGUF

Không phải mọi nguồn GGUF đều mang lại mức độ tin cậy như nhau.

Dưới đây là hệ thống phân cấp nguồn thực tế:

| Nguồn | Những gì bạn nhận được | Sử dụng tốt nhất |

|---|---|---|

| ggml-org trên Hugging Face | Các repo GGUF kiểu chính thức, phù hợp với cách dùng llama.cpp | Điểm dừng chân đầu tiên tốt nhất cho người dùng llama.cpp |

| Thư viện Ollama | Cài đặt cục bộ được quản lý cho các bản build Gemma 4 | Điểm dừng chân tốt nhất cho sự đơn giản |

| bartowski trên Hugging Face | Nhiều tệp tin GGUF cộng đồng đã được lượng tử hóa | Tốt nhất khi bạn cần nhiều lựa chọn quant hơn |

| Trọng số chính thức từ Google / Kaggle | Safetensors và ngữ cảnh phân phối chính chủ | Tốt nhất để kiểm tra nguồn gốc, không dùng trực tiếp GGUF |

Nếu mối quan tâm chính của bạn là nguồn gốc (provenance), hãy bắt đầu nghiên cứu với các kênh chính thức của Google Gemma 4 và sau đó chuyển sang hệ sinh thái llama.cpp đáng tin cậy. Nếu mối quan tâm chính của bạn là sự tiện lợi, Ollama thường là câu trả lời tốt hơn so với việc tải về Gemma 4 một cách thủ công.

Các tùy chọn Gemma 4 trên Hugging Face

Đối với nhiều độc giả, lộ trình GGUF thực tế nhất bắt đầu từ các repository Gemma 4 trên Hugging Face.

Bạn thường có hai lộ trình Hugging Face:

- Sử dụng các repo của ggml-org cho một lộ trình GGUF thân thiện với llama.cpp trực tiếp hơn.

- Sử dụng các repo quant cộng đồng như bartowski khi bạn cần một tệp tin cụ thể như

Q4_K_M.

Đó là lý do tại sao Gemma 4 Hugging Face là một cụm từ quan trọng trong thiết lập cục bộ. Đó không chỉ là nơi bạn duyệt xem. Đó là nơi bạn quyết định xem mình muốn sự căn chỉnh kiểu chính chủ hay các tùy chọn quant cộng đồng rộng rãi hơn.

Lộ trình Gemma 4 GGUF nhanh nhất với llama.cpp

Con đường nhanh nhất trong llama.cpp là chế độ -hf trực tiếp.

Hãy cài đặt llama.cpp trước:

brew install llama.cpp

Hoặc trên Windows:

winget install llama.cpp

Sau đó xác minh:

llama-cli --version

llama-server --version

Bây giờ, hãy chạy luồng GGUF kiểu máy chủ đơn giản nhất:

llama-server -hf ggml-org/gemma-4-26B-A4B-it-GGUF

Lệnh đó giúp llama.cpp tự động xử lý việc tải về Gemma 4 và bộ nhớ đệm cục bộ. Nếu bạn muốn có một endpoint cục bộ tương thích với OpenAI, đây là con đường mượt mà nhất.

Tải Gemma 4 thủ công với Hugging Face CLI

Một số người dùng muốn có một tệp tin cụ thể rõ ràng thay vì được lấy tự động.

Đó là lúc các lệnh tải về Gemma 4 thủ công giúp ích:

pip install -U "huggingface_hub[cli]"

huggingface-cli download bartowski/google_gemma-4-31B-it-GGUF \

--include "google_gemma-4-31B-it-Q4_K_M.gguf" \

--local-dir ./

Sau đó chạy nó cục bộ:

llama-cli -m ./google_gemma-4-31B-it-Q4_K_M.gguf -p "Trong một câu, Gemma 4 là gì?"

Kiểu thiết lập này tốt hơn khi bạn quan tâm đến tên tệp tin chính xác, lựa chọn quant chính xác, hoặc các kịch bản triển khai có thể lặp lại.

Cách dễ nhất để tải về Gemma 4 nếu bạn không muốn dùng các tệp tin thủ công

Một quy trình làm việc GGUF thủ công hoàn chỉnh không phải lúc nào cũng là lựa chọn đúng cho người mới bắt đầu.

Nếu bạn chủ yếu muốn một lần chạy cục bộ đơn giản, hãy sử dụng Ollama:

ollama --version

ollama pull gemma4

ollama list

ollama run gemma4 "Hãy cho tôi một bài kiểm tra một dòng."

Bạn cũng có thể tải các tag kích thước cụ thể như gemma4:e2b, gemma4:e4b, gemma4:26b, và gemma4:31b khi các tag đó phù hợp với kế hoạch của bạn.

Đối với nhiều người, đây là con đường tải về Gemma 4 khởi đầu tốt hơn so với quy trình GGUF thủ công, bởi vì Ollama quản lý vòng đời của mô hình cục bộ cho bạn.

Cách xác minh thiết lập Gemma 4 GGUF của bạn đã hoạt động

Thiết lập GGUF của bạn chỉ hoàn tất khi bạn xác minh được quá trình vận hành (runtime).

Đối với chế độ máy chủ llama.cpp:

curl http://localhost:8080/v1/chat/completions \

-H "Content-Type: application/json" \

-H "Authorization: Bearer no-key" \

-d '{

"messages": [

{"role": "system", "content": "Bạn là một trợ lý hữu ích."},

{"role": "user", "content": "Trong một câu: Gemma 4 là gì?"}

]

}'

Đối với Ollama:

curl http://localhost:11434/api/generate -d '{

"model": "gemma4",

"prompt": "Hãy đưa ra một kết quả kiểm tra một dòng."

}'

Nếu thiết lập của bạn vượt qua cả việc tải tệp tin và phản hồi prompt thật, bạn đang ở vị thế tốt để chuyển sang các bài kiểm tra tác vụ thực tế.

Các vấn đề thường gặp với Gemma 4 GGUF

Một hướng dẫn thông minh nên cảnh báo bạn về những vấn đề trong tuần đầu tiên mà mọi người thực sự gặp phải.

Vấn đề 1: Mô hình tải kém hoặc thất bại trong giao diện đồ họa (GUI)

Một số công cụ GUI chậm hơn llama.cpp trong việc cập nhật hỗ trợ sau khi một mô hình mới được phát hành. Nếu bản build GGUF của bạn thất bại trong một ứng dụng, hãy kiểm tra cùng mô hình đó trong phiên bản llama.cpp mới nhất trước khi bạn cho rằng tệp tin bị hỏng.

Vấn đề 2: Lỗi tràn bộ nhớ (out-of-memory)

Nếu một bản build GGUF đã tải được nhưng bị treo hoặc chạy rất tệ, giải pháp thường là một trong những cách sau:

- Chọn một mức quant nhỏ hơn.

- Chọn một mô hình nhỏ hơn.

- Giảm mức sử dụng ngữ cảnh.

- Đừng mặc định coi 31B là bài kiểm tra đầu tiên đúng đắn.

Vấn đề 3: Không khớp về phương thức dữ liệu (modality)

Gia đình mô hình này có thể hỗ trợ âm thanh trên lý thuyết, nhưng các công cụ cục bộ có thể chậm hơn trong việc hỗ trợ tính năng đó. Một tệp tin GGUF không đảm bảo rằng mọi môi trường thời gian chạy đều cung cấp mọi phương thức dữ liệu ngay từ ngày đầu tiên.

Bước tiếp theo sau khi thiết lập xong Gemma 4 GGUF

Sau khi thiết lập GGUF hoàn tất, các hướng dẫn này là bước tiếp theo tốt nhất:

- Gemma 4 là gì?

- Đánh giá Gemma 4

- Cách chạy Gemma 4 với llama.cpp

- Cách chạy Gemma 4 trong Ollama

- Yêu cầu phần cứng cho Gemma 4

Khuyến nghị cuối cùng về việc tải Gemma 4 GGUF

Khuyến nghị cuối cùng từ hướng dẫn này rất đơn giản: nếu bạn muốn quyền kiểm soát, hãy sử dụng ggml-org hoặc một nguồn GGUF Hugging Face Gemma 4 đáng tin cậy với llama.cpp; nếu bạn muốn sự tiện lợi, hãy sử dụng Ollama; và nếu bạn muốn tỷ lệ thành công cao nhất, hãy bắt đầu với cái gì đó nhỏ hơn những gì bạn nghĩ.

Việc tải về Gemma 4 GGUF thành công không phải là việc lấy tệp tin đầu tiên bạn thấy. Đó là việc chọn đúng nguồn, đúng mức quant, và đúng môi trường thời gian chạy ngay từ đầu.

Hướng dẫn liên quan

Tiếp tục khám phá cụm nội dung Gemma 4 với bài hướng dẫn tiếp theo phù hợp với quyết định hiện tại của bạn.

llama.cpp có hỗ trợ Gemma 4 không? Trạng thái GGUF, các bản sửa lỗi và những gì hoạt động

Một câu trả lời thực tế cho câu hỏi liệu llama.cpp có hỗ trợ Gemma 4 hay không, kèm theo các liên kết GGUF chính thức, trạng thái hỗ trợ hiện tại và ý nghĩa thực sự của việc 'được hỗ trợ'.

Cách chạy Gemma 4 với llama.cpp: Hướng dẫn thiết lập GGUF, Phần cứng & Lượng tử hóa

Mọi thứ bạn cần để chạy Gemma 4 cục bộ với llama.cpp: bảng phần cứng, câu lệnh build có thể sao chép-dán, hướng dẫn lượng tử hóa và thiết lập đa phương thức.

Hướng dẫn API Gemma 4: Thiết lập cục bộ tương thích OpenAI

Sử dụng hướng dẫn API Gemma 4 này để xây dựng một endpoint cục bộ tương thích OpenAI, kiểm tra nhanh chóng và chọn đúng runtime cho quy trình làm việc của bạn.

Vẫn chưa biết nên đọc gì tiếp theo?

Quay lại trung tâm hướng dẫn để duyệt các bài so sánh model, hướng dẫn cài đặt và trang lập kế hoạch phần cứng.