Gemma 4 ガイド

Gemma 4 GGUF ダウンロードガイド:安全なソース、量子化のコツ、ローカルセットアップ

Gemma 4 GGUF のダウンロードが必要な方は、すでに「このモデルは何?」という段階を超えているはずです。あなたが求めているのは、Gemma 4 を安全にダウンロードし、適切な量子化を選び、時間を無駄にすることなくローカル環境で動作させるための最短経路でしょう。

このガイドはその目的のために作成されました。信頼できるソース、Hugging Face リポジトリの使いどころ、llama.cpp での GGUF ビルドの実行方法、そしてよりシンプルな Ollama ルートについてカバーしています。

Gemma 4 GGUF のダウンロード:最大ではなく、最適なファイルから始める

GGUF ワークフローにおける最大の失敗は、「最大のファイルが自動的に最高のファイルである」と思い込んでしまうことです。

Gemma 4 をダウンロードする前に、まず自分のマシンに実際に適合するファミリーメンバーを決めてください。

- E2B: 最も軽量なエントリーポイントが必要な場合

- E4B: バランスの取れた初回ローカル実行を求める場合

- 26B A4B: 高い品質と効率性の両立を求める場合

- 31B: 最高峰の Dense(高密度)モデルを求める場合

その上で、メモリ容量に基づいて量子化を選びます。GGUF の経路が有用なのは、選んだファイルがご自身のハードウェアで快適に動作できる場合のみです。

モデル選びにまだ迷っている場合は、まずGemma 4 とは?を読んでください。

Gemma 4 GGUF とは?

Gemma 4 GGUF は、効率的なローカル推論とメタデータ対応パッケージのために設計された、llama.cpp フレンドリーなバイナリモデル形式です。

実務上、Gemma 4 GGUF が重要となるのは、以下のようなニーズがある場合です。

- llama.cpp との互換性

- 限られたメモリ予算に合わせた量子化ファイル

- ローカル CLI またはローカルサーバーデプロイへの直接的なパス

多くのローカル開発者にとって、Gemma 4 GGUF はモデルの公開から、実際に利用可能なセルフホスト型ワークフローへの最も実用的な架け橋となります。

ローカルでの制御が目的であれば、多くの場合、GGUF ルートが最短経路となります。

Gemma 4 GGUF ダウンロードの信頼できるソース

すべての GGUF 提供元が同じ信頼レベルであるわけではありません。

以下は、実用的なソースの優先順位です。

| ソース | 得られるもの | 最適な用途 |

|---|---|---|

| Hugging Face の ggml-org | llama.cpp の使用に最適化された公式スタイルのリポジトリ | llama.cpp ユーザーの第一候補 |

| Ollama ライブラリ | 管理された Gemma 4 ビルドのローカルインストール | シンプルさを追求する場合の第一候補 |

| Hugging Face の bartowski | コミュニティによる多彩な量子化済み GGUF ファイル | より多くの量子化選択肢が必要な場合 |

| 公式 Google / Kaggle ウェイト | Safetensors や第一パーティの配布資料 | 出所の確認用(直接 GGUF として使うためではない) |

出所を最も重視するのであれば、Google 公式の Gemma 4 チャネルから調査を始め、信頼できる llama.cpp エコシステムへと移行してください。利便性を最優先するのであれば、手動でのダウンロードよりも Ollama が適した回答になることが多いでしょう。

Gemma 4 の Hugging Face オプション

多くの読者にとって、最も実用的な GGUF への道は Hugging Face リポジトリから始まります。

通常、以下の2つのパスがあります。

- ggml-org リポジトリを使用して、より直接的な llama.cpp フレンドリーな GGUF 経路を辿る。

- bartowski などのコミュニティリポジトリを使用して、

Q4_K_Mなどの特定の量子化ファイルを入手する。

これが、ローカルセットアップにおいて Hugging Face が重要な意味を持つ理由です。単に閲覧する場所ではなく、「公式に近い整合性」か「コミュニティによる幅広い量子化オプション」かを選択する場所なのです。

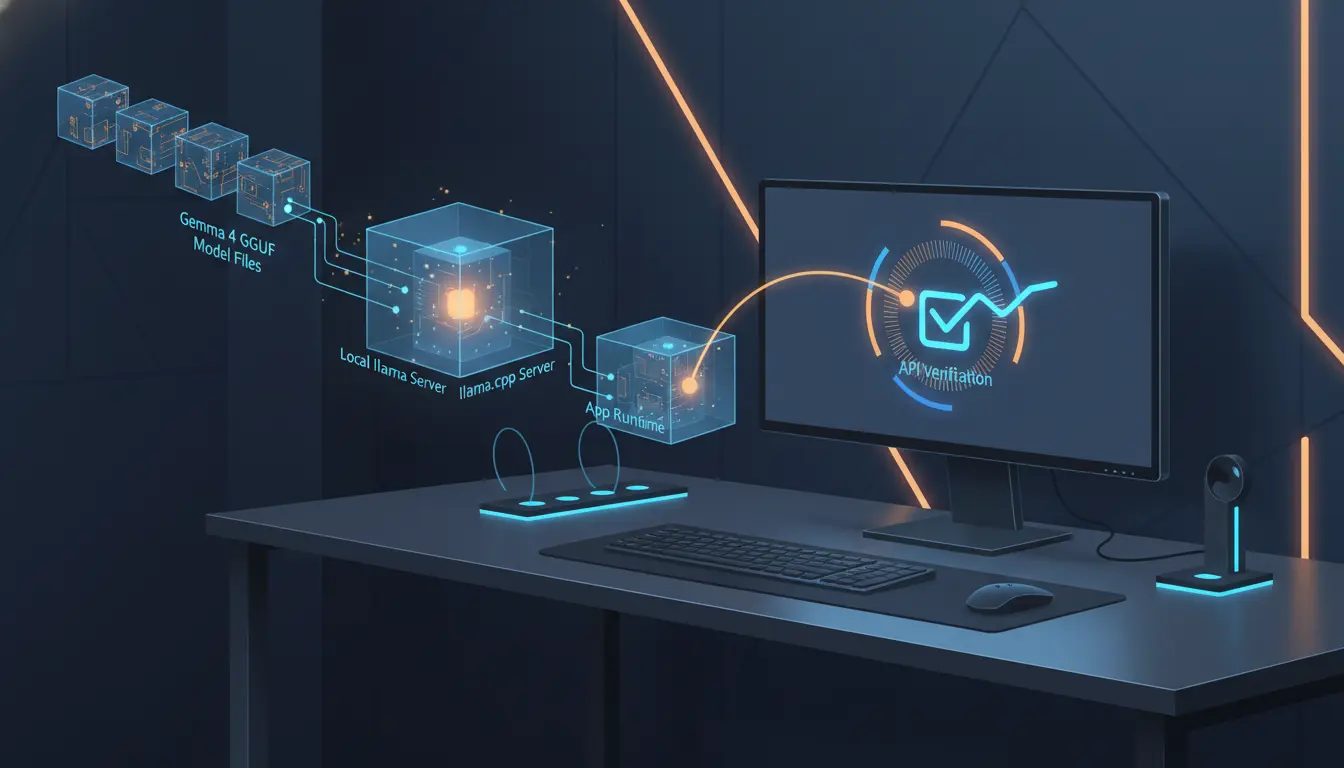

llama.cpp を使った Gemma 4 GGUF の最速セットアップ

llama.cpp における最短ルートは、直接的に -hf モードを使用することです。

まず、llama.cpp をインストールします(macOS の場合)。

brew install llama.cpp

Windows の場合:

winget install llama.cpp

バージョンを確認します。

llama-cli --version

llama-server --version

次に、最もシンプルなサーバー形式のフローを実行します。

llama-server -hf ggml-org/gemma-4-26B-A4B-it-GGUF

このコマンドにより、llama.cpp が Gemma 4 のダウンロードとローカルキャッシュを自動的に処理します。OpenAI 互換のローカルエンドポイントが必要な場合、これが最もスムーズなルートです。

Hugging Face CLI を使った手動ダウンロード

自動取得ではなく、特定のファイルを明示的に指定してダウンロードしたいユーザーもいるでしょう。

その場合は、以下のような手動コマンドが役立ちます。

pip install -U "huggingface_hub[cli]"

huggingface-cli download bartowski/google_gemma-4-31B-it-GGUF \

--include "google_gemma-4-31B-it-Q4_K_M.gguf" \

--local-dir ./

その後、ローカルで実行します。

llama-cli -m ./google_gemma-4-31B-it-Q4_K_M.gguf -p "Gemma 4 とは何ですか?一文で答えてください。"

このスタイルは、正確なファイル名や量子化の選択、再現可能なデプロイスクリプトを重視する場合に適しています。

手動操作を避けたい場合の最も簡単なダウンロード方法

初心者にとって、完全手動の GGUF ワークフローが常に正しい選択とは限りません。

シンプルなローカル実行が目的であれば、Ollama を使用してください。

ollama --version

ollama pull gemma4

ollama list

ollama run gemma4 "テスト出力を一文でお願いします。"

必要に応じて、gemma4:e2b、gemma4:e4b、gemma4:26b、gemma4:31b といったサイズ指定のタグを指定することも可能です。

多くの人にとって、Ollama がローカルモデルのライフサイクルを管理してくれるため、手動の GGUF ワークフローよりも優れた第一歩となります。

セットアップが成功したか確認する方法

ランタイムを確認するまで、セットアップは完了していません。

llama.cpp サーバーモードの場合:

curl http://localhost:8080/v1/chat/completions \

-H "Content-Type: application/json" \

-H "Authorization: Bearer no-key" \

-d '{

"messages": [

{"role": "system", "content": "あなたは親切なアシスタントです。"},

{"role": "user", "content": "一文で答えてください:Gemma 4 とは何ですか?"}

]

}'

Ollama の場合:

curl http://localhost:11434/api/generate -d '{

"model": "gemma4",

"prompt": "テスト出力を一文で返してください。"

}'

ファイルの読み込みに成功し、実際のプロンプトへの応答が得られれば、実際のタスク検証に進む準備が整ったと言えます。

よくあるトラブル

1. モデルの読み込みがうまくいかない、または GUI で失敗する

新しいモデルのリリース直後、一部の GUI ツールは llama.cpp の最新のサポート状況に追いついていないことがあります。特定のアプリで失敗する場合は、ファイル自体が壊れていると判断する前に、最新の llama.cpp で同じモデルをテストしてみてください。

2. メモリ不足 (Out-of-memory) エラー

読み込みはできてもクラッシュしたり動作が不安定な場合は、以下のいずれかで解決することが多いです。

- より小さい量子化を選ぶ

- より小さいモデル(31B ではなく 26B や E4B など)を選ぶ

- コンテキストの使用量を減らす

3. モダリティ(形式)の不一致

スペック上は音声に対応していても、ローカルツール側がまだ対応していないことがあります。GGUF ファイルであるからといって、あらゆるランタイムで初日からすべての機能(画像や音声)が使えるとは限りません。

セットアップ後の次のステップ

GGUF のセットアップが完了したら、以下のガイドが参考になります。

最終的な推奨事項

このガイドの推奨はシンプルです。細かく制御したいのであれば、llama.cpp と共に ggml-org や信頼できる Hugging Face ソースを使用してください。手軽さを求めるなら Ollama を、そして成功の確率を最大限に高めたいのであれば、想定よりも少し小さなモデルから始めてください。

優れたセットアップとは、最初に見つけたファイルをとりあえず落とすことではなく、最初から正しいソース、適切な量子化、そして最適なランタイムを選ぶことなのです。

関連記事

Gemma 4 の記事群をそのまま辿り、今の判断にいちばん近い次の記事へ進んでください。

llama.cpp は Gemma 4 に対応している? GGUF の状況、修正、動作確認済みモデル

llama.cpp が Gemma 4 をサポートしているかという疑問に対し、公式 GGUF リンク、現在のサポート状況、そして「サポート済み」が具体的に何を意味するのかを詳しく回答します。

llama.cpp で Gemma 4 を実行する方法: GGUF 設定、ハードウェア、量子化ガイド

Gemma 4 を llama.cpp でローカル実行するために必要なすべて:ハードウェア対応表、コピー&ペーストで使えるビルドコマンド、量子化ガイド、マルチモーダルセットアップ。

Gemma 4 API ガイド:ローカルでの OpenAI 互換環境の構築

この Gemma 4 API ガイドを活用して、ローカルで OpenAI 互換のエンドポイントを構築し、迅速にテストを行い、ワークフローに最適なランタイムを選択しましょう。

次に何を読めばいいか迷っていますか?

ガイド一覧に戻って、モデル比較、ローカル導入、ハードウェア計画の3方向から続けて見ていけます。