Gemma 4 ガイド

Gemma 4 AI とは? Google Gemma 4 のリリース、各モデル、使い始め方

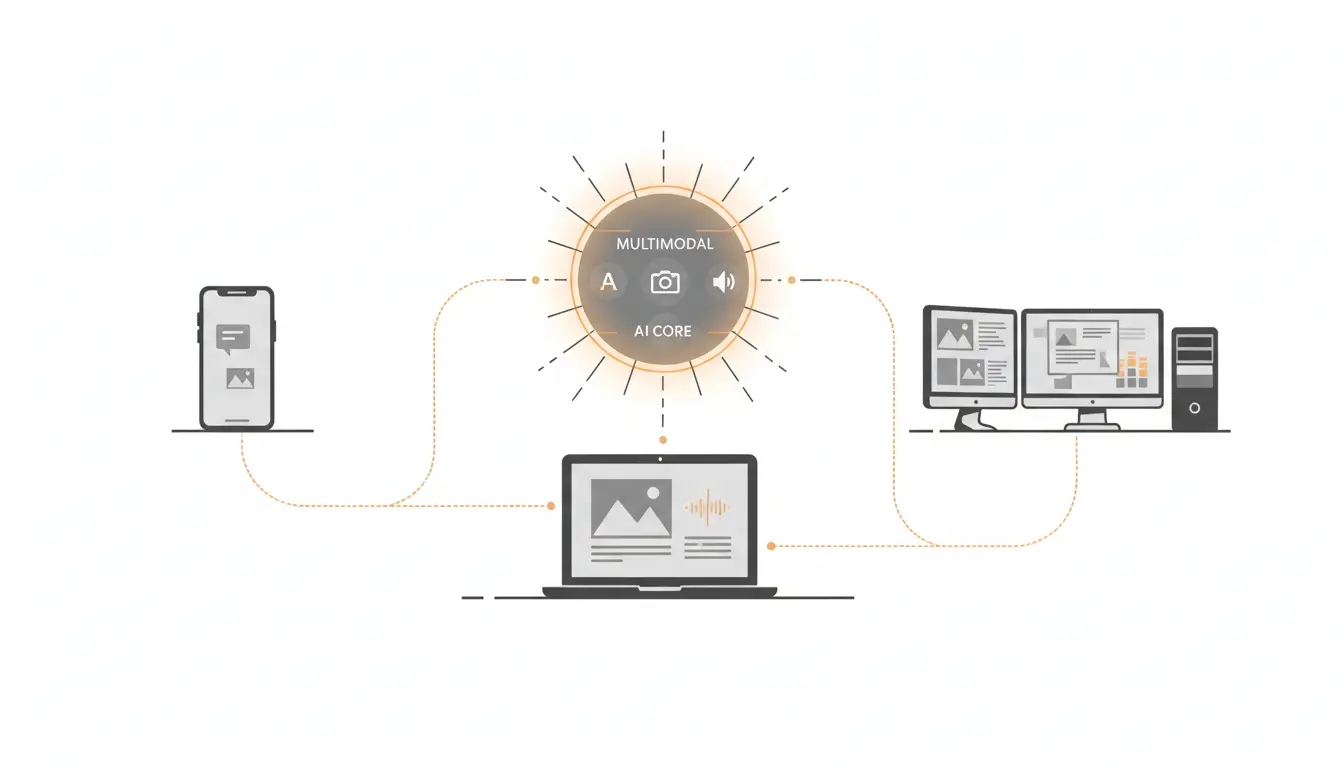

Gemma 4 とは何かという問いに対し、簡潔に答えるならば、Gemma 4 AI は Google DeepMind が開発した、ローカル、エッジ、およびサーバー利用向けの最新のオープンウェイト・マルチモーダルモデルファミリーです。

この定義は正確ですが、十分ではありません。より詳しく説明すると、Google Gemma 4 は2026年4月2日にリリースされた4つのモデルからなるファミリーであり、軽量なローカル環境での実験から、本格的なワークステーションやプロダクション環境までのすべてをカバーするように設計されています。

Gemma 4 AI とは?

Gemma 4 の最も明快な答えは、E2B、E4B、26B A4B、31B の4つのバリアントを含む、Apache 2.0 ライセンスのモデルファミリーであるということです。

実用的な側面から見ると、Gemma 4 AI は以下の機能を提供します。

- 全モデルでテキストおよび画像の入力に対応

- 小型のエッジ向けモデルでの音声入力に対応

- E2B および E4B で 128K のコンテキストをサポート

- 26B A4B および 31B で 256K のコンテキストをサポート

- 従来の Gemma リリースよりも分かりやすく寛容なライセンス

つまり、Gemma 4 について語る際に重要なのは、単なる新しいモデルであるということだけでなく、Google が役割の明確なフルラインナップとして構築したという点です。

Google Gemma 4 リリースの重要性

今回の Gemma 4 リリースが重要である理由は2つあります。

第一に、推論、コーディング、科学、およびマルチモーダルタスクにおいて、公式ベンチマークで非常に強力なポジションを確立している点です。第二に、ライセンスが Apache 2.0 に移行したことで、Gemma 4 AI を商用利用や社内利用のために評価することが以前よりはるかに容易になった点です。

人々がこのモデルに強い関心を寄せるのは、単に好奇心からではありません。Google Gemma 4 が「開発の基盤とするに値するモデルか」を判断しようとしているのです。

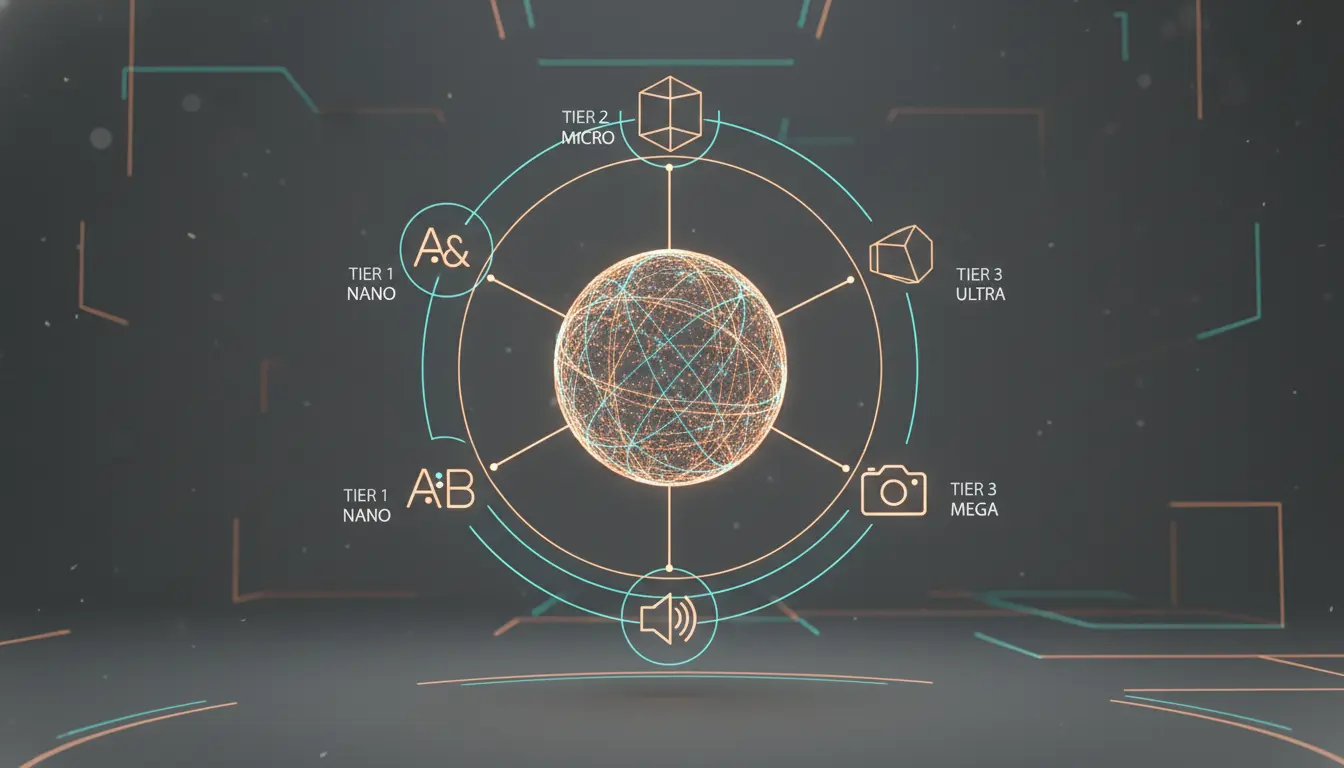

Google Gemma 4 モデルラインナップ

自分に適したモデルを選ぶためには、4つのバリアントの違いを理解する必要があります。

| モデル | アーキテクチャ | コンテキスト | モダリティ | およその Q4 メモリ要件 |

|---|---|---|---|---|

| Gemma 4 E2B | エッジ向け Dense | 128K | テキスト, 画像, 音声 | 3.2 GB |

| Gemma 4 E4B | エッジ向け Dense | 128K | テキスト, 画像, 音声 | 5.0 GB |

| Gemma 4 26B A4B | MoE | 256K | テキスト, 画像 | 15.6 GB |

| Gemma 4 31B | Dense | 256K | テキスト, 画像 | 17.4 GB |

この表があるからこそ、Gemma 4 AI は他のモデルよりも計画が立てやすいと言えます。Google Gemma 4 は、ハードウェアや予算の制約に合わせて適切なモデルを提案してくれます。

どの Gemma 4 モデルから始めるべきか?

現実的な答えは、自分のマシンスペックに合うものを選ぶことです。

- メモリを最小限に抑えたいなら E2B。

- 最もバランスの取れたローカル試行をしたいなら E4B。

- 効率性を重視しつつ、より強力な出力を求めるなら 26B A4B。

- ファミリーで最高の品質を求め、それを支えるハードウェアがあるなら 31B。

多くの方にとって、E4B が最も推奨しやすいモデルです。本格的な実力を感じさせる十分なサイズでありながら、ローカルでのテストが現実的な軽さを維持しています。

Gemma 4 AI における「有効パラメータ数」とは?

これはリリース時に多くの人を混乱させたポイントです。

小型モデルは「有効パラメータ」を持つエッジモデルと説明され、26B A4B は推論中のアクティブパラメータが少ない MoE モデルです。しかし、これはメモリの確保が不要という意味ではありません。Gemma 4 AI は依然として物理的なメモリを必要とし、MoE モデルであっても、すべてのパラメータが常にアクティブではないにせよ、それらを保持するための相応のメモリフットプリントが必要になります。

Gemma 4 AI のベンチマークは本当に良いのか?

初心者向けの答えは、膨大なスプレッドシートではなく、公開された結果のシンプルな解釈です。

31B と 26B A4B は、AIME 2026、LiveCodeBench v6、MMMU Pro、GPQA Diamond で非常に強力な公式数値を記録しています。また、ユーザーの好みを反映したアリーナ形式の比較においても競争力のあるパフォーマンスを示しています。平易な言葉で言えば、Gemma 4 AI は単に「オープンであること」だけが魅力ではありません。トップモデルが「純粋に強力であること」が魅力なのです。

2026年にオープンモデルを評価しているチームにとって、Gemma 4 AI は実際のハードウェアやデプロイの選択肢にマッピングしやすいため、非常に際立った存在となっています。

詳細なスコアの内訳については、Gemma 4 レビューをご覧ください。

なぜ Apache 2.0 が重要なのか

ライセンスの変更は、今回の大きなトピックの一つです。

Google Gemma 4 は、標準的で寛容なソフトウェアライセンスである Apache 2.0 を採用しています。多くのチームにとって、これは独自の制約が少なく、法的な不確実性が減り、プロダクト評価への道がシンプルになることを意味します。従来の Gemma 世代と比較して、これは運用面での最大の改善点の一つと言えます。

ビジネスの視点から見れば、答えは単なる「新しい AI モデル」ではなく、「導入がはるかに容易になった新しい AI モデル」なのです。

どのように Gemma 4 AI を始めればよいか?

どのような「始め方」をしたいかによります。

最も簡単なローカル実行:

より詳細な制御と GGUF サポートが必要な場合:

モデルや導入パスを比較検討したい場合:

最後に:Gemma 4 とは何か?

Gemma 4 AI とは、特定のデプロイパスに縛られることなく、最新のマルチモーダル能力を求める人々のための、Google DeepMind による Apache 2.0 オープンウェイトモデルファミリーです。

一言でまとめるなら、「開発の基盤とするに十分な、強力で、明確で、オープンな Google のモデルラインナップがついに登場した」と言えるでしょう。

詳細は Gemma 4 レビュー や Gemma 4 GGUF ダウンロードガイド でご確認ください。

関連記事

Gemma 4 の記事群をそのまま辿り、今の判断にいちばん近い次の記事へ進んでください。

llama.cpp は Gemma 4 に対応している? GGUF の状況、修正、動作確認済みモデル

llama.cpp が Gemma 4 をサポートしているかという疑問に対し、公式 GGUF リンク、現在のサポート状況、そして「サポート済み」が具体的に何を意味するのかを詳しく回答します。

LM Studio は Gemma 4 に対応している? 互換性、モデル一覧、要件

LM Studio が Gemma 4 をサポートしているかという問いに対し、サポート対象モデルの一覧、最小メモリ要件、そして実際のセットアップにおける期待値を明らかにします。

Unsloth は Gemma 4 に対応している? ローカル実行とファインチューニングの状況

Unsloth が Gemma 4 をサポートしているかという疑問に対し、ローカル実行、ファインチューニングのサポート、および重要なモデル固有の注意点を詳しく解説します。

次に何を読めばいいか迷っていますか?

ガイド一覧に戻って、モデル比較、ローカル導入、ハードウェア計画の3方向から続けて見ていけます。