Hướng dẫn Gemma 4

Gemma 4 AI là gì? Bản phát hành Google Gemma 4, các mô hình và cách bắt đầu

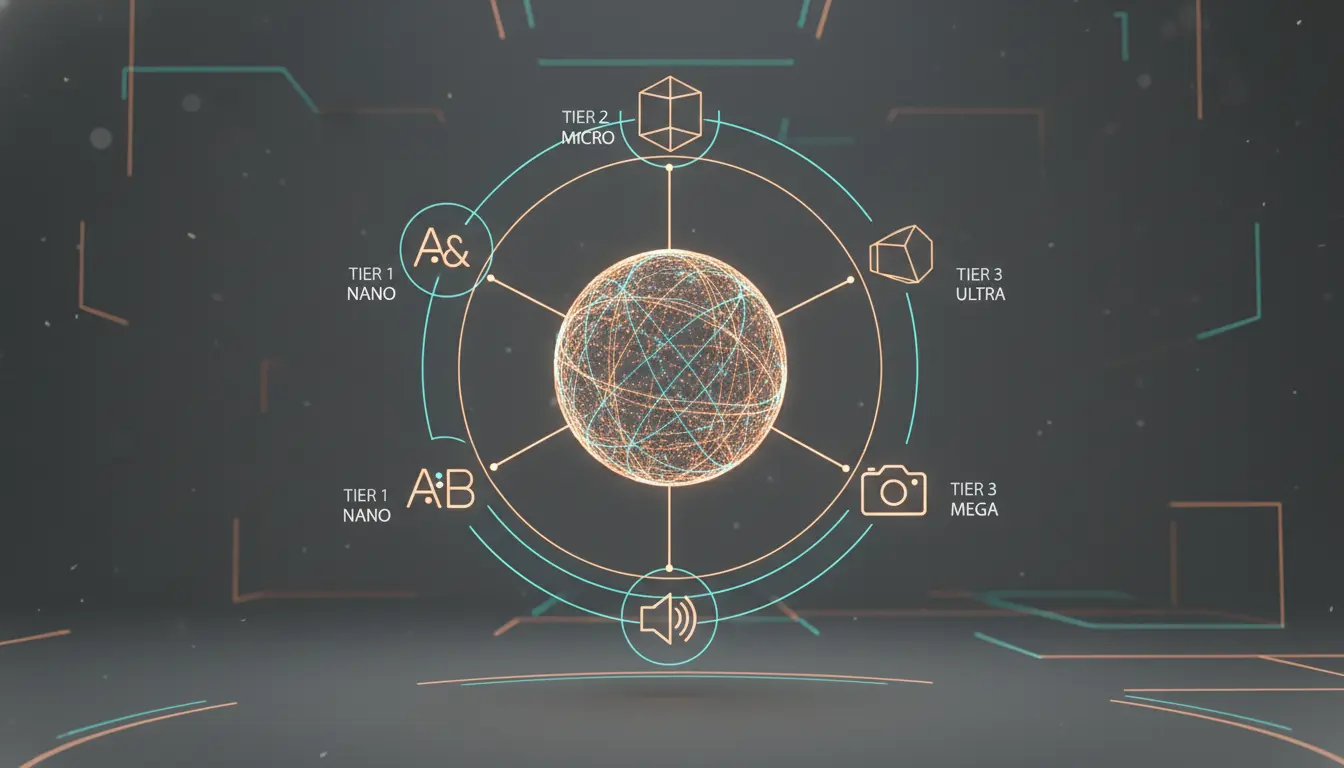

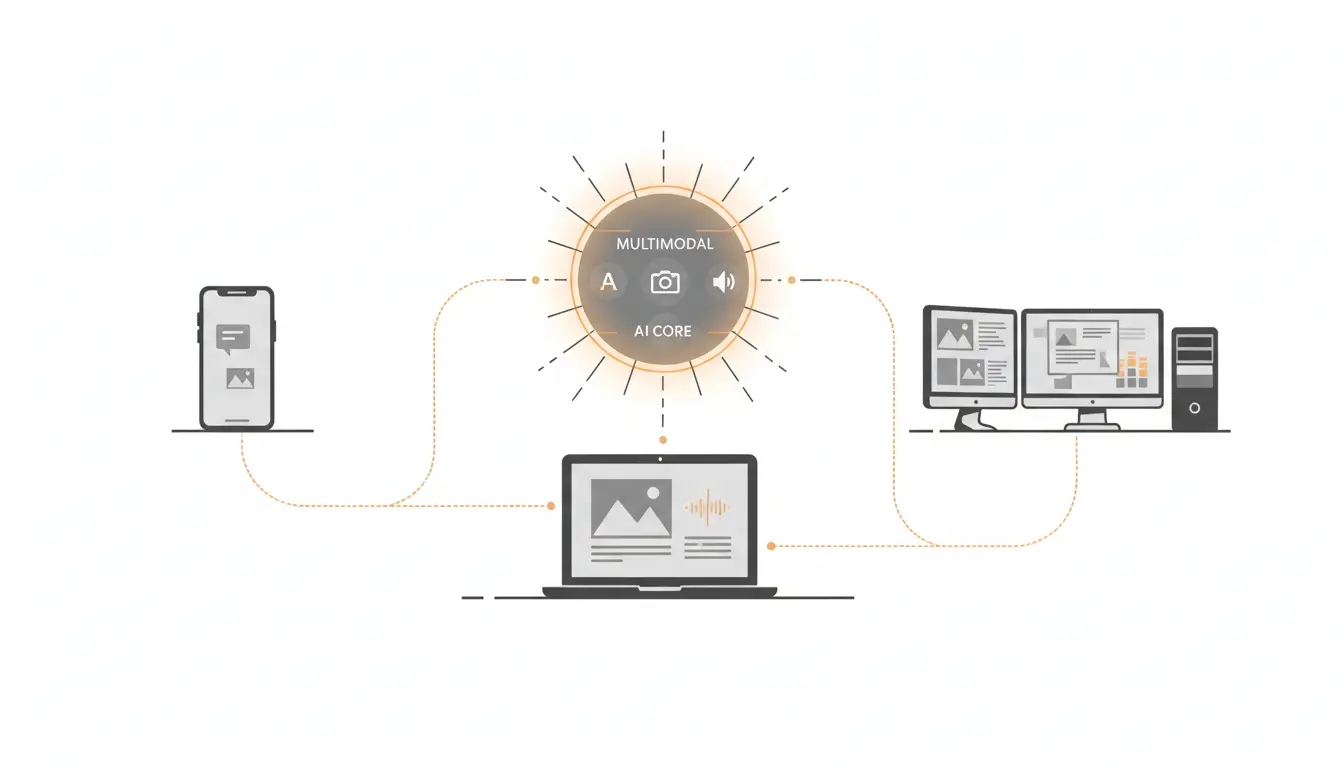

Nếu bạn đang thắc mắc Gemma 4 là gì, câu trả lời ngắn gọn là Gemma 4 AI là gia đình mô hình đa phương thức trọng số mở (open-weight) mới nhất của Google DeepMind, dành cho việc sử dụng cục bộ (local), tại thiết bị biên (edge) và trên máy chủ (server).

Định nghĩa đơn giản đó rất hữu ích, nhưng vẫn chưa đủ. Cách hiểu tốt hơn là Google Gemma 4 là một gia đình gồm bốn mô hình được phát hành vào ngày 2 tháng 4 năm 2026, được thiết kế để bao quát mọi thứ, từ các thử nghiệm cục bộ nhẹ nhàng cho đến các khối lượng công việc workstation và sản xuất nghiêm túc.

Gemma 4 là gì?

Câu trả lời rõ ràng nhất cho Gemma 4 là gì chính là điều này: Google Gemma 4 là một gia đình mô hình sử dụng giấy phép Apache 2.0, bao gồm các phiên bản E2B, E4B, 26B A4B và 31B.

Về mặt thực tế, Gemma 4 AI mang lại cho bạn:

- Đầu vào văn bản và hình ảnh trên toàn bộ các mô hình.

- Đầu vào âm thanh trên các mô hình biên nhỏ hơn.

- Ngữ cảnh 128K trên E2B và E4B.

- Ngữ cảnh 256K trên 26B A4B và 31B.

- Một câu chuyện về giấy phép sạch sẽ hơn so với các bản phát hành Gemma trước đó.

Vì vậy, khi có ai đó hỏi về Gemma 4, phần quan trọng không chỉ là nó là một mô hình mới. Mà đó là việc Google Gemma 4 được cấu trúc như một dòng sản phẩm hoàn chỉnh với các vai trò rõ ràng.

Tại sao bản phát hành Google Gemma 4 lại quan trọng?

Bản phát hành Gemma 4 quan trọng vì hai lý do.

Thứ nhất, Google Gemma 4 xuất hiện với vị thế benchmark chính thức mạnh mẽ trong các tác vụ lập luận (reasoning), lập trình (coding), khoa học và đa phương thức. Thứ hai, bản phát hành Gemma 4 đã chuyển gia đình mô hình này sang giấy phép Apache 2.0, giúp cho Gemma 4 AI dễ dàng được đánh giá hơn rất nhiều cho mục đích thương mại và nội bộ.

Đó là lý do tại sao đây đang trở thành một câu hỏi có "ý định cao". Mọi người không chỉ tò mò về mô hình này. Họ đang quyết định xem Google Gemma 4 có xứng đáng để xây dựng nền tảng xung quanh hay không.

Dòng sản phẩm mô hình Google Gemma 4

Để trả lời điều đó một cách thỏa đáng, bạn cần hiểu về bốn mô hình này.

| Mô hình | Kiến trúc | Cửa sổ ngữ cảnh | Các phương thức (Modalities) | Bộ nhớ Q4 xấp xỉ |

|---|---|---|---|---|

| Gemma 4 E2B | Dense (hướng tới Edge) | 128K | Văn bản, hình ảnh, âm thanh | 3.2 GB |

| Gemma 4 E4B | Dense (hướng tới Edge) | 128K | Văn bản, hình ảnh, âm thanh | 5.0 GB |

| Gemma 4 26B A4B | MoE | 256K | Văn bản, hình ảnh | 15.6 GB |

| Gemma 4 31B | Dense | 256K | Văn bản, hình ảnh | 17.4 GB |

Bảng này chính là lý do tại sao Gemma 4 AI dễ dàng lập kế hoạch hơn nhiều so với nhiều đợt ra mắt khác. Google Gemma 4 không bắt bạn phải sử dụng một mô hình khổng lồ duy nhất nếu máy tính hoặc ngân sách của bạn không cho phép.

Bạn nên bắt đầu với mô hình Gemma 4 nào?

Một cách thực tế để trả lời là hãy hỏi xem phiên bản nào phù hợp với máy tính của bạn.

- Bắt đầu với E2B nếu bạn muốn rào cản bộ nhớ thấp nhất.

- Bắt đầu với E4B nếu bạn muốn một sự thử nghiệm cục bộ cân bằng nhất.

- Hãy nhìn vào 26B A4B nếu bạn muốn đầu ra mạnh mẽ hơn với thiết kế cao cấp hiệu quả hơn.

- Chọn 31B nếu bạn muốn chất lượng tốt nhất trong gia đình mô hình này và bạn có phần cứng để hỗ trợ nó.

Đối với hầu hết độc giả đặt câu hỏi này, E4B là khuyến nghị dễ dàng nhất. Nó đủ lớn để mang lại cảm giác nghiêm túc và đủ nhỏ để việc thử nghiệm cục bộ trở nên thực tế.

"Thông số hiệu dụng" (effective parameters) nghĩa là gì trong Gemma 4 AI?

Phần này gây nhầm lẫn cho nhiều độc giả lần đầu tìm hiểu về bản phát hành Gemma 4.

Các mô hình nhỏ hơn được mô tả là các mô hình biên có "thông số hiệu dụng", trong khi 26B A4B là một mô hình MoE (Mixture-of-Experts) với các thông số hoạt động (active parameters) thấp hơn trong quá trình suy luận. Điều đó không có nghĩa là việc lập kế hoạch bộ nhớ biến mất. Gemma 4 AI vẫn cần bộ nhớ cho các trọng số (weights), và mô hình MoE lớn hơn vẫn đòi hỏi một mức chiếm dụng bộ nhớ đáng kể ngay cả khi không phải tất cả các thông số đều hoạt động trên mỗi token.

Đó là lý do tại sao câu trả lời hữu ích nhất cho người mới bắt đầu bao gồm cả kế hoạch bộ nhớ, chứ không chỉ là tên các mô hình.

Các benchmark của Gemma 4 có thực sự tốt không?

Đối với người mới bắt đầu, câu trả lời đúng không phải là một bảng tính khổng lồ. Đó là một cách giải thích đơn giản về các kết quả đã công bố.

Các mô hình 31B và 26B A4B đạt được những con số chính thức mạnh mẽ trên các bài kiểm tra AIME 2026, LiveCodeBench v6, MMMU Pro và GPQA Diamond. Chúng cũng cho thấy hiệu suất cạnh tranh trên các bảng xếp hạng ưu tiên kiểu Arena. Nói một cách dễ hiểu, Gemma 4 AI thú vị không chỉ vì nó là mã nguồn mở (open). Nó thú vị vì các mô hình hàng đầu thực sự có khả năng cạnh tranh.

Vị thế cạnh tranh đó là lý do lớn khiến Gemma 4 AI trở nên quan trọng hơn chỉ là một bản phát hành gây tò mò.

Tại sao Apache 2.0 lại quan trọng?

Sự thay đổi về giấy phép là một phần quan trọng của câu chuyện.

Google Gemma 4 sử dụng Apache 2.0, một loại giấy phép phần mềm nguồn mở tiêu chuẩn và thông thoáng. Đối với nhiều đội ngũ, điều đó có nghĩa là ít hạn chế tùy chỉnh hơn, ít sự không chắc chắn về mặt pháp lý hơn và một lộ trình đánh giá sản phẩm đơn giản hơn. Nếu bạn so sánh bản phát hành Gemma 4 với các thế hệ Gemma trước đây, đây là một trong những cải tiến vận hành lớn nhất.

Bạn bắt đầu với Gemma 4 AI như thế nào?

Con đường tốt nhất cho người mới bắt đầu phụ thuộc vào loại khởi đầu mà bạn muốn.

Nếu bạn muốn lộ trình cục bộ dễ dàng nhất, hãy sử dụng Ollama:

Nếu bạn muốn quyền kiểm soát nhiều hơn và hỗ trợ GGUF, hãy sử dụng llama.cpp:

Câu trả lời cuối cùng: Gemma 4 là gì?

Câu trả lời cuối cùng cho Gemma 4 là gì chính là: Gemma 4 AI là gia đình mô hình trọng số mở Apache 2.0 của Google DeepMind dành cho những người muốn có khả năng đa phương thức hiện đại mà không muốn bị bó buộc vào một lộ trình triển khai duy nhất.

Nếu bạn muốn một thông tin ngắn gọn nhất, câu hỏi thực sự là: "Liệu hiện nay đã có một dòng sản phẩm Google Gemma 4 đủ mạnh, đủ rõ ràng và đủ mở để xây dựng nền tảng hay chưa?". Câu trả lời là có, và nơi dễ dàng nhất để tiếp tục tìm hiểu là Đánh giá Gemma 4 hoặc Hướng dẫn tải Gemma 4 GGUF.

Hướng dẫn liên quan

Tiếp tục khám phá cụm nội dung Gemma 4 với bài hướng dẫn tiếp theo phù hợp với quyết định hiện tại của bạn.

llama.cpp có hỗ trợ Gemma 4 không? Trạng thái GGUF, các bản sửa lỗi và những gì hoạt động

Một câu trả lời thực tế cho câu hỏi liệu llama.cpp có hỗ trợ Gemma 4 hay không, kèm theo các liên kết GGUF chính thức, trạng thái hỗ trợ hiện tại và ý nghĩa thực sự của việc 'được hỗ trợ'.

LM Studio có hỗ trợ Gemma 4 không? Tính tương thích, danh sách mô hình và yêu cầu

Một câu trả lời rõ ràng cho câu hỏi liệu LM Studio có hỗ trợ Gemma 4 hay không, kèm theo danh sách mô hình được hỗ trợ, yêu cầu bộ nhớ tối thiểu và những kỳ vọng thiết lập thực tế.

Unsloth có hỗ trợ Gemma 4 không? Trạng thái chạy cục bộ và Fine-Tuning

Một câu trả lời thực tế cho câu hỏi liệu Unsloth có hỗ trợ Gemma 4 hay không, bao gồm hỗ trợ chạy cục bộ, hỗ trợ fine-tuning và những lưu ý quan trọng theo từng mô hình.

Vẫn chưa biết nên đọc gì tiếp theo?

Quay lại trung tâm hướng dẫn để duyệt các bài so sánh model, hướng dẫn cài đặt và trang lập kế hoạch phần cứng.