Gemma-4-Leitfäden

Was ist Gemma 4 AI? Google Gemma 4 Release, Modelle und Einstieg

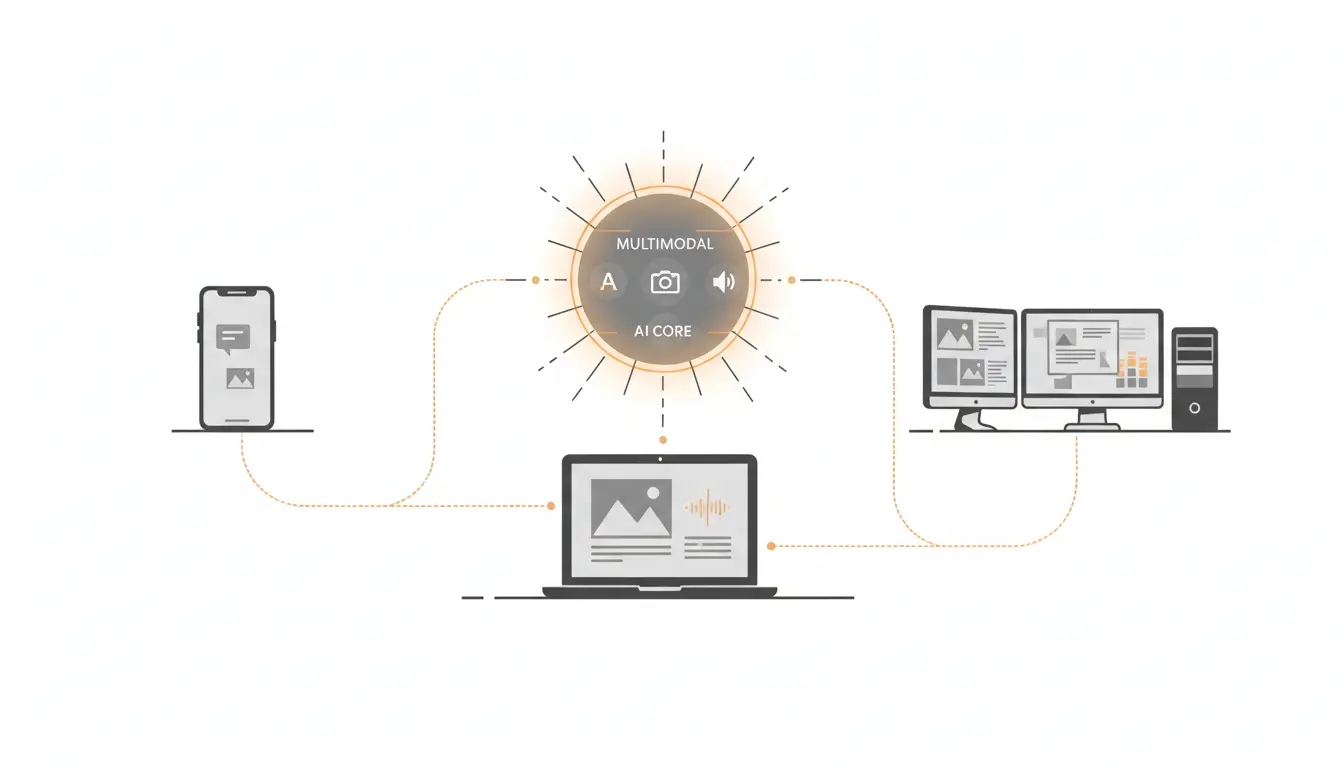

Wenn Sie sich fragen, was Gemma 4 ist, lautet die kurze Antwort: Gemma 4 AI ist Google DeepMinds neueste Open-Weight-Multimodal-Modellfamilie für lokale, Edge- und Server-Anwendungen.

Diese einfache Definition ist nützlich, aber nicht ausreichend. Treffender ist: Google Gemma 4 ist eine Familie aus vier Modellen, die am 2. April 2026 veröffentlicht wurde und alles von leichten lokalen Experimenten bis zu ernsthaften Workstation- und Produktions-Workloads abdecken soll.

Was ist Gemma 4?

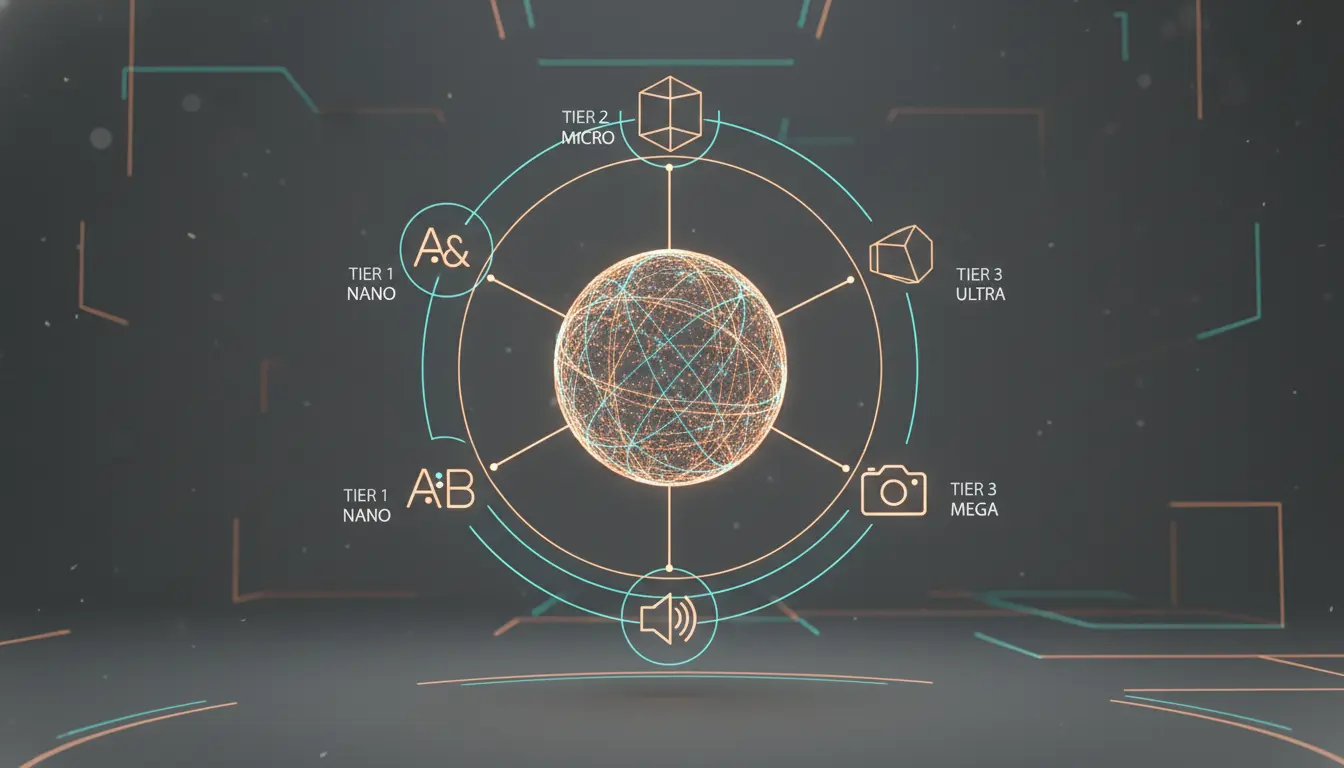

Die klarste Antwort auf was ist Gemma 4 lautet: Google Gemma 4 ist eine unter Apache 2.0 lizenzierte Modellfamilie mit E2B, E4B, 26B A4B und 31B.

In der Praxis bietet Ihnen Gemma 4 AI:

- Text- und Bildeingabe in der gesamten Familie

- Audioeingabe bei den kleineren Edge-Modellen

- 128K Kontext bei E2B und E4B

- 256K Kontext bei 26B A4B und 31B

- eine klarere Lizenzlage als frühere Gemma-Releases

Wenn also jemand nach Gemma 4 fragt, ist der wichtige Punkt nicht nur, dass es ein neues Modell ist. Entscheidend ist, dass Google Gemma 4 als vollständige Produktlinie mit klaren Rollen aufgebaut ist.

Warum das Google-Gemma-4-Release wichtig ist

Das Gemma-4-Release ist aus zwei Gründen wichtig.

Erstens kommt Google Gemma 4 mit starker offizieller Benchmark-Positionierung bei Reasoning, Coding, Wissenschaft und multimodalen Aufgaben. Zweitens wurde die Familie mit dem Gemma-4-Release auf Apache 2.0 umgestellt, was Gemma 4 AI für kommerzielle und interne Evaluierung deutlich einfacher macht.

Deshalb ist die Frage so intent-stark geworden. Menschen sind nicht nur neugierig auf das Modell. Sie entscheiden, ob Google Gemma 4 ein Fundament ist, auf dem es sich lohnt aufzubauen.

Google-Gemma-4-Modellübersicht

Um das richtig einzuordnen, müssen Sie die vier Modelle verstehen.

| Modell | Architektur | Kontextfenster | Modalitäten | Ungefährer Q4-Speicher |

|---|---|---|---|---|

| Gemma 4 E2B | Edge-orientiert, dicht | 128K | Text, Bild, Audio | 3,2 GB |

| Gemma 4 E4B | Edge-orientiert, dicht | 128K | Text, Bild, Audio | 5,0 GB |

| Gemma 4 26B A4B | MoE | 256K | Text, Bild | 15,6 GB |

| Gemma 4 31B | Dicht | 256K | Text, Bild | 17,4 GB |

Gerade diese Tabelle macht Gemma 4 AI planbarer als viele andere Releases. Google Gemma 4 zwingt Sie nicht zu einem riesigen Modell, wenn Ihre Maschine oder Ihr Budget etwas anderes verlangt.

Mit welchem Gemma-4-Modell sollten Sie beginnen?

Praktisch beantworten Sie das, indem Sie fragen, welche Version zu Ihrer Maschine passt.

- Starten Sie mit E2B, wenn Sie die niedrigste Speicherhürde wollen.

- Starten Sie mit E4B, wenn Sie einen ausgewogenen ersten lokalen Test möchten.

- Schauen Sie sich 26B A4B an, wenn Sie stärkere Ausgabe mit effizienterem High-End-Design wollen.

- Wählen Sie 31B, wenn Sie die beste Qualität der Familie möchten und die Hardware dafür haben.

Für die meisten Leser ist E4B die einfachste Empfehlung. Es ist groß genug, um ernst zu wirken, und klein genug, um lokale Tests realistisch zu halten.

Was bedeuten „effective parameters“ bei Gemma 4 AI?

Dieser Teil verwirrt viele Menschen, die das Gemma-4-Release zum ersten Mal lesen.

Die kleineren Modelle werden als Edge-Modelle mit „effective parameters“ beschrieben, während 26B A4B ein MoE-Modell mit weniger aktiven Parametern pro Inferenz ist. Das heißt nicht, dass Speicherplanung verschwindet. Gemma 4 AI benötigt weiterhin echten Gewichtsspeicher, und auch das größere MoE-Modell braucht trotz geringerer aktiver Parameter pro Token einen erheblichen Footprint.

Deshalb enthält die nützlichste Anfängerantwort immer Speicherplanung und nicht nur Modellnamen.

Sind die Gemma-4-Benchmarks wirklich gut?

Für Einsteiger ist der richtige Ausgangspunkt keine riesige Tabelle, sondern eine einfache Einordnung der veröffentlichten Ergebnisse.

Die Modelle 31B und 26B A4B liefern starke offizielle Werte bei AIME 2026, LiveCodeBench v6, MMMU Pro und GPQA Diamond. Sie zeigen außerdem wettbewerbsfähige Ergebnisse in Arena-ähnlichen Präferenz-Snapshots. Einfach gesagt: Gemma 4 AI ist nicht nur interessant, weil es offen ist. Es ist interessant, weil die Top-Modelle wirklich konkurrenzfähig sind.

Diese Wettbewerbsfähigkeit ist ein wesentlicher Grund dafür, dass Gemma 4 AI mehr als nur ein neugieriges Release geworden ist.

Für Teams, die 2026 offene Modelle evaluieren, sticht Google Gemma 4 heraus, weil Gemma 4 AI sich ungewöhnlich leicht auf reale Hardware und reale Deployment-Entscheidungen abbilden lässt.

Wenn Sie den detaillierten Score-Breakdown möchten, lesen Sie den vollständigen Gemma-4-Review.

Warum Apache 2.0 wichtig ist

Der Lizenzwechsel ist ein zentraler Teil der Geschichte.

Google Gemma 4 verwendet Apache 2.0, eine standardisierte, permissive Softwarelizenz. Für viele Teams bedeutet das weniger Sonderregeln, weniger rechtliche Unsicherheit und einen geradlinigeren Weg zur Produktevaluierung. Vergleicht man das Gemma-4-Release mit früheren Gemma-Generationen, ist dies eine der größten operativen Verbesserungen.

Wenn Sie die Frage also aus Business-Sicht stellen, lautet die Antwort nicht nur „ein neues Google-Modell“. Sie lautet: „ein neues Google-Modell, das sich deutlich leichter übernehmen lässt“.

Wie starten Sie mit Gemma 4 AI?

Der beste Einstieg hängt davon ab, welche Art von Start Sie wollen.

Wenn Sie den einfachsten lokalen Weg möchten, verwenden Sie Ollama:

Wenn Sie mehr Kontrolle und GGUF-Unterstützung möchten, verwenden Sie llama.cpp:

Wenn Sie Modelle und Deployment-Pfade noch vergleichen, halten Sie diese Seiten offen:

Schlussantwort: Was ist Gemma 4?

Die endgültige Antwort auf was ist Gemma 4 lautet: Gemma 4 AI ist Google DeepMinds unter Apache 2.0 veröffentlichte Open-Weight-Modellfamilie für Menschen, die moderne multimodale Fähigkeiten wollen, ohne sich auf einen einzigen Deployment-Pfad festzulegen.

Wenn Sie nur ein kurzes Fazit wollen, lautet die eigentliche Frage: „Gibt es jetzt eine Google-Gemma-4-Produktlinie, die stark genug, klar genug und offen genug ist, um darauf aufzubauen?“ Die Antwort ist ja, und der einfachste nächste Schritt ist der Gemma-4-Review oder der Gemma-4-GGUF-Download-Leitfaden.

Verwandte Leitfäden

Gehen Sie im Gemma-4-Cluster mit dem nächsten Leitfaden weiter, der zu Ihrer aktuellen Entscheidung passt.

Unterstützt llama.cpp Gemma 4? GGUF-Status, Fixes und was funktioniert

Eine praxisnahe Antwort darauf, ob llama.cpp Gemma 4 unterstützt, mit offiziellen GGUF-Links, aktuellem Support-Status und der Frage, was „unterstützt“ wirklich bedeutet.

Unterstützt LM Studio Gemma 4? Kompatibilität, Modellliste und Anforderungen

Eine klare Antwort darauf, ob LM Studio Gemma 4 unterstützt, inklusive unterstützter Modellliste, Mindestarbeitsspeicher und realistischer Setup-Erwartungen.

Unterstützt Unsloth Gemma 4? Status für lokalen Betrieb und Fine-Tuning

Eine praxisnahe Antwort darauf, ob Unsloth Gemma 4 unterstützt, inklusive lokalem Betrieb, Fine-Tuning-Support und den modellbezogenen Einschränkungen, die wirklich zählen.

Sie wissen noch nicht, was Sie als Nächstes lesen sollen?

Gehen Sie zurück zum Leitfaden-Hub, um Modellvergleiche, Setup-Anleitungen und Seiten zur Hardware-Planung zu durchsuchen.