Gemma 4 E2B vs. E4B: Welches kleine Modell sollten Sie wählen?

Ein praxisnaher Leitfaden zu Gemma 4 E2B vs. E4B für alle, die zwischen den beiden kleinen Modellen wählen, inklusive echter Benchmark-Abstände und Speicherhinweisen.

Gemma-4-Leitfäden

Lokale Setup-Anleitungen, Tabellen zu Hardwareanforderungen und Hinweise zur Modellauswahl für alle, die Gemma 4 evaluieren.

Wenn Sie zuerst nur wenige Seiten lesen, starten Sie mit Modellauswahl, Hardware-Planung und den häufigsten Setup- oder Vergleichsfragen.

Ein praxisnaher Leitfaden zu Gemma 4 E2B vs. E4B für alle, die zwischen den beiden kleinen Modellen wählen, inklusive echter Benchmark-Abstände und Speicherhinweisen.

Ein praxisnaher Vergleich von Gemma 4 26B vs. 31B für alle, die zwischen dem MoE-Sweet-Spot und dem stärksten dichten Modell der Familie entscheiden.

Ein praxisnaher Gemma-4-VRAM-Rechner und Modellauswähler auf Basis offizieller Speicherwerte, damit Sie das richtige Modell wählen, bevor Sie etwas herunterladen.

Vergleiche innerhalb der Modellfamilie und Leitfäden zur Versionswahl für alle, die entscheiden möchten, welchen Gemma-4-Weg sie nehmen sollen.

Zwei der stärksten Open-Weight-Modelle aus China im Jahr 2026, im Abstand von zwei Wochen veröffentlicht und auf ähnliche Coding-Workloads ausgerichtet — aber mit realen Unterschieden bei Modalität, Kontext und Preisstruktur.

Entschlüsseln Sie Gemma 4s Benennungssystem, vergleichen Sie Benchmarks über alle vier Varianten hinweg und finden Sie das richtige Modell für Ihre Hardware, bevor Sie irgendetwas herunterladen.

Gemma 4 vs. Qwen ist keine Frage mit einem Ein-Zeilen-Sieger. Dieser Leitfaden hilft Ihnen, anhand von Workflow, Hardware, Deployment und Ökosystem-Fit zu entscheiden.

Praktische Setup-Anleitungen für Ollama, LM Studio, llama.cpp, Google AI Studio und angrenzende Gemma-4-Workflows.

Die offiziellen Token-Preise für Kimi K2.6, was gecachte und ungecachte Eingaben bedeuten, wie die Rate-Limit-Stufen wirklich funktionieren und welche Zusatzkosten – etwa Websuche – beim Budgetieren oft übersehen werden.

Alles, was Entwickler aus der Model Card von `moonshotai/Kimi-K2.6` brauchen: was in den Gewichten steckt, wie Deployment mit vLLM oder SGLang funktioniert und wann Self-Hosting besser ist als die offizielle API.

Kimi K2.6 erschien am 20. April 2026 als Open-Weight-Modell für agentisches Coding mit 256K Kontext, nativer Bild- und Videoeingabe und einer aggressiven Agent-Swarm-Story. Dieses Review trennt Substanz von Marketing.

Ein praxisnaher Leitfaden für Kimi K2.6 in Ollama über den offiziellen Eintrag `kimi-k2.6:cloud` — inklusive Setup-Befehlen, Integrationen mit Coding-Agenten und den Folgen eines cloudbasierten Ollama-Modells.

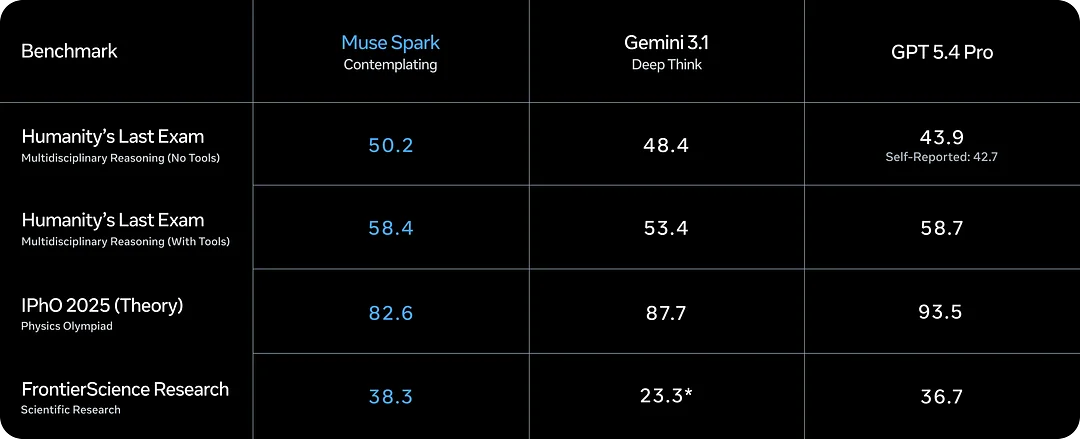

Muse Spark ist Metas neues KI-Modell aus den Meta Superintelligence Labs. Dieser Leitfaden erklärt Kernfähigkeiten, den Contemplating-Modus, Benchmarks und worauf man vor dem Einsatz achten sollte.

Eine praxisnahe Antwort darauf, ob llama.cpp Gemma 4 unterstützt, mit offiziellen GGUF-Links, aktuellem Support-Status und der Frage, was „unterstützt“ wirklich bedeutet.

Eine klare Antwort darauf, ob LM Studio Gemma 4 unterstützt, inklusive unterstützter Modellliste, Mindestarbeitsspeicher und realistischer Setup-Erwartungen.

Eine praxisnahe Antwort darauf, ob Unsloth Gemma 4 unterstützt, inklusive lokalem Betrieb, Fine-Tuning-Support und den modellbezogenen Einschränkungen, die wirklich zählen.

Ein praxisnaher Leitfaden zu Gemma 4 auf dem iPhone mit Fokus auf iOS-Setup, Modellwahl, Geräte-Fit, Offline-Nutzung und der zu erwartenden Leistung.

Nutzen Sie diesen Gemma-4-API-Leitfaden, um einen lokalen OpenAI-kompatiblen Endpoint zu bauen, ihn schnell zu testen und die richtige Runtime für Ihren Workflow zu wählen.

Ein praxisnaher Setup-Leitfaden für Gemma 4 unter Windows mit Hardware-Checks, Ollama, LM Studio, Modellwahl und den häufigsten Windows-Problemen.

Nutzen Sie diesen Schritt-für-Schritt-Leitfaden, um Gemma 4 mit Unsloth feinabzustimmen, das richtige Modell für Ihre Hardware zu wählen und das Ergebnis nach Ollama, llama.cpp oder LM Studio zu exportieren.

Nutzen Sie diesen Gemma-4-GGUF-Download-Leitfaden, um eine vertrauenswürdige Quelle zu wählen, die richtige Datei auszuwählen und mit weniger Rätselraten vom Download zur ersten lokalen Antwort zu kommen.

Nutzen Sie dieses Gemma-4-Review, um die Modellfamilie, die wichtigsten Benchmark-Zahlen und die realen Deployment-Trade-offs zu verstehen, bevor Sie sich festlegen.

Wenn Sie sich fragen, was Gemma 4 ist, erklärt dieser Leitfaden das Release, die Modellgrößen, Kontextgrenzen, Lizenzierung und die einfachsten Wege zum Einstieg.

Google AI Studio ist eine der schnellsten Möglichkeiten, gehosteten Gemma-4-Zugang zu evaluieren, vor allem wenn Sie sich noch nicht auf ein lokales Setup festlegen möchten.

Nutzen Sie diesen Leitfaden, um zu verstehen, wo Unsloth in einen Gemma-4-Workflow passt und was Sie entscheiden sollten, bevor Sie ins Tuning einsteigen.

Ein praxisnaher LM-Studio-Leitfaden für Gemma 4 mit Fokus auf Modellwahl, Hardware-Fit, First-Run-Workflow und darauf, was Sie prüfen sollten, bevor Sie dem Modell die Schuld geben.

Alles, was Sie brauchen, um Gemma 4 lokal mit llama.cpp auszuführen: Hardwaretabellen, Copy-and-paste-Befehle, Quantisierungsleitfaden und multimodales Setup.

Seiten zu Hardwareanforderungen und maschinenspezifische Planungsleitfäden, damit Sie nicht zuerst das falsche Modell herunterladen.

Ein fokussierter Leitfaden zu Gemma-4-26B-A4B-VRAM-Anforderungen mit exakten GGUF-Größen, Planungsbereichen und der Frage, warum 26B der lokale Sweet Spot ist.

Ein fokussierter Leitfaden zu Gemma-4-31B-VRAM-Anforderungen mit exakten GGUF-Größen, Planungsbereichen und ehrlicher Einschätzung dazu, welche Hardware wirklich Sinn ergibt.

Ein fokussierter Leitfaden zu Gemma-4-E2B-VRAM-Anforderungen mit exakten Dateigrößen, praxisnahen Planungsbereichen und ehrlicher Einordnung, wann E2B die richtige Wahl ist.

Ein fokussierter Leitfaden zu Gemma-4-E4B-VRAM-Anforderungen mit exakten Größen, Planungsbereichen und praktischer Beratung für lokale KI auf Laptop-Niveau.

Wenn Sie sich fragen, ob ein Mac mini Gemma 4 ausführen kann, hängt die echte Antwort davon ab, welches Gemma-4-Modell Sie meinen und welche Art von Erlebnis Sie erwarten.

Ein praxisnaher Hardware-Leitfaden zu Gemma 4 mit offizieller ungefährer Speichertabelle und einer einfachen Empfehlung, welches Modell Sie zuerst probieren sollten.

Der schnellste Weg von null zu einem funktionierenden lokalen Gemma-4-Lauf: der richtige Tag, die richtige Hardware-Prüfung und der richtige Befehl.