Gemma-4-Leitfäden

Muse Spark erklärt: Metas multimodales Reasoning-Modell

Wenn Sie nach Muse Spark suchen, wollen Sie wahrscheinlich verstehen, was Meta gerade angekündigt hat, warum es relevant ist und ob es für Ihre Arbeit von Bedeutung ist. Dieser Leitfaden deckt all das ab – ohne Marketingrhetorik.

Muse Spark ist Metas neues multimodales Reasoning-Modell und das erste bedeutende Modell der Meta Superintelligence Labs. Es ist kein routinemäßiges Llama-Update. Es steht für einen umfassenderen strategischen Neustart, bei dem Meta sich auf persönliche KI-Assistenz, natives multimodales Reasoning und eine tiefere Integration im Ökosystem der Consumer-Produkte ausrichtet.

Was ist Muse Spark?

Muse Spark ist das neue multimodale Reasoning-Modell von Meta und das erste bedeutende Modell aus den Meta Superintelligence Labs. Basierend auf öffentlich verfügbaren Informationen präsentiert Meta Muse Spark nicht als einfach „das nächste Llama". Stattdessen wird es als Grundlage einer neuen Produktstrategie positioniert, die auf persönliche KI-Assistenz, multimodales Reasoning und breitere Integration im Consumer-Ökosystem von Meta ausgerichtet ist.

Für Leser, die nach Muse Spark suchen, ist der wichtigste Gedanke dieser: Muse Spark zielt darauf ab, Text, Bilder, Tools und Nutzerkontext in einem System zu verstehen. Das macht es nicht nur für KI-Enthusiasten relevant, sondern auch für Entwickler, Kreative und alltägliche Nutzer, die leistungsfähigere Assistenten in Consumer-Produkten wünschen.

Warum Muse Spark wichtig ist

Muse Spark ist wichtig, weil es einen strategischen Neustart signalisiert. Es wird als Metas Antwort auf wachsenden Wettbewerbsdruck von OpenAI, Anthropic und Google nach Kritik rund um Llama 4 beschrieben. In der Praxis scheint Muse Spark Metas Versuch zu sein, von einer allgemeinen Open-Model-Erzählung hin zu einem stärker produktgetriebenen KI-Stack zu wechseln, der für nutzerzugewandte Erlebnisse optimiert ist.

Dieser Wandel ist sowohl für KI-Käufer als auch für Entwickler bedeutend. Wenn Muse Spark erfolgreich ist, könnte es die Funktionsweise von KI-Assistenten in Meta-Produkten wie Facebook, Instagram, WhatsApp, Messenger und Wearables prägen. Das verschafft Muse Spark einen deutlich größeren Consumer-Distributionsweg als die meisten neuen Modelle beim Launch erhalten.

Muse Spark und die Strategie der „persönlichen Superintelligenz"

Eines der markantesten Elemente der Muse Spark-Geschichte ist Metas Positionierung um „persönliche Superintelligenz". Meta möchte, dass Muse Spark mehr als ein Chatbot wird. Die langfristige Idee ist ein Assistent, der Ihre Welt versteht, bei wichtigen Entscheidungen hilft und mit einem reichhaltigeren persönlichen Kontext agiert als ein typisches entwicklerzentriertes Modell.

Diese Strategie unterscheidet Muse Spark von Enterprise-First-KI-Produkten. Sie deutet darauf hin, dass Meta Personalisierung, multimodale Eingabe und direkten Verbrauchernutzen priorisiert. Für Nutzer könnte das bedeutsamere alltägliche Unterstützung bedeuten. Für datenschutzbewusste Leser wirft es auch berechtigte Fragen zur Datennutzung, zu Kontoanforderungen und zur Funktionsweise personalisierter KI-Erlebnisse auf.

Kernfähigkeiten von Muse Spark

1. Natives multimodales Reasoning

Muse Spark wurde als natives multimodales Modell entwickelt und nicht als Textmodell mit nachträglich hinzugefügter Vision-Fähigkeit. Das ist bedeutsam, weil natives Multimodal in der Regel auf stärkeres Bildverständnis, natürlicheres krossmodales Reasoning und bessere Leistung bei Aufgaben hinweist, die visuellen Kontext mit Sprache kombinieren.

Konkrete Fähigkeiten umfassen:

- Analyse von Fotos und Extraktion praktischer Informationen aus visueller Eingabe.

- Bearbeitung visueller MINT-Aufgaben wie Objekterkennung, Diagramminterpretation und räumliches Denken.

- Umwandlung von Textbeschreibungen in leichtgewichtige interaktive Erlebnisse wie einfache Webseiten oder Mini-Spiele.

Das obige Ernährungsbeispiel verdeutlicht, wie Muse Spark reale Bildeingaben verarbeiten und strukturierte, handlungsrelevante Informationen zurückliefern kann — ein Muster, das besonders wichtig ist, wenn man bedenkt, wie viele tägliche Consumer-Anfragen Fotos beinhalten.

Das Spielgenerierungsbeispiel zeigt Muse Spark bei einer kreativen multimodalen Aufgabe: Eine Textbeschreibung aufnehmen und eine interaktive Ausgabe erzeugen. Das ist eine Fähigkeit, die sowohl ein Consumer-Differenzierungsmerkmal als auch ein Entwicklerwerkzeug ist.

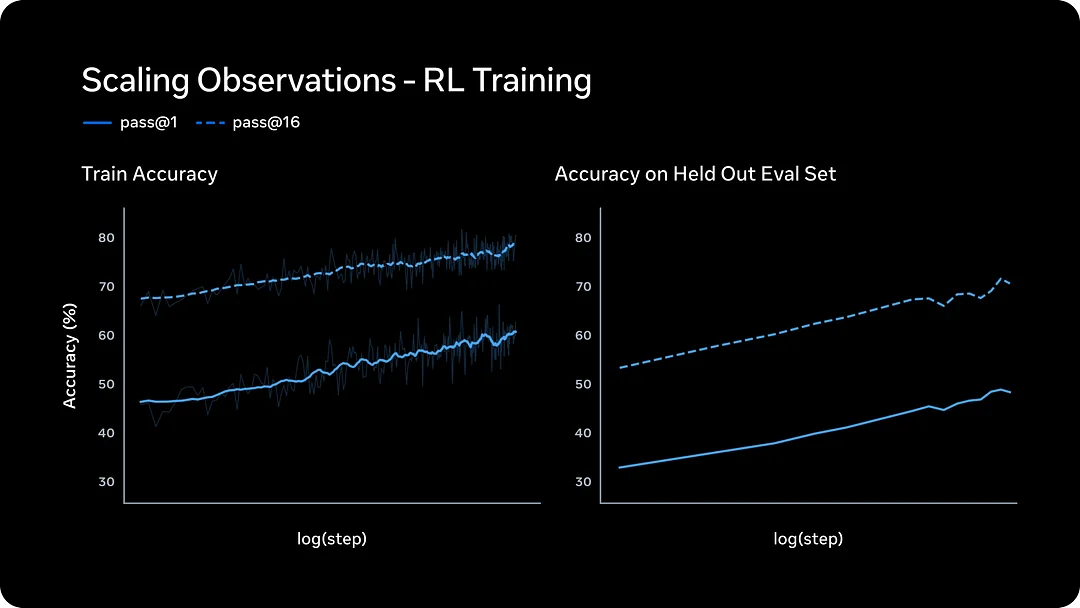

2. Contemplating-Modus und Multi-Agent-Orchestrierung

Das bemerkenswerteste Feature von Muse Spark ist der Contemplating-Modus. Statt die Denkzeit eines einzelnen Modells rein linear zu verlängern, startet Muse Spark Berichten zufolge mehrere Sub-Agents parallel und kombiniert deren Ausgaben. Meta bezeichnet dies als Multi-Agent-Orchestrierung.

Für Nutzer ist der praktische Wert dieses Ansatzes einfach: Er zielt darauf ab, die Reasoning-Qualität zu verbessern, ohne dass die Latenz strikt eins zu eins wächst. Theoretisch gibt das Muse Spark bessere Chancen bei schwierigen Fragen, offenen Recherche-Anfragen und komplexen multimodalen Aufgaben, bei denen eine einzelne kurze Antwort zu oberflächlich wäre.

Aus praktischer Perspektive ist das eines der wichtigsten Dinge, die man über Muse Spark verstehen sollte: Es konkurriert direkt mit den „Thinking Mode"-Systemen von OpenAI, Anthropic und Google — aber mit einer Parallel-Agent-Architektur statt verlängertem Single-Chain-Reasoning.

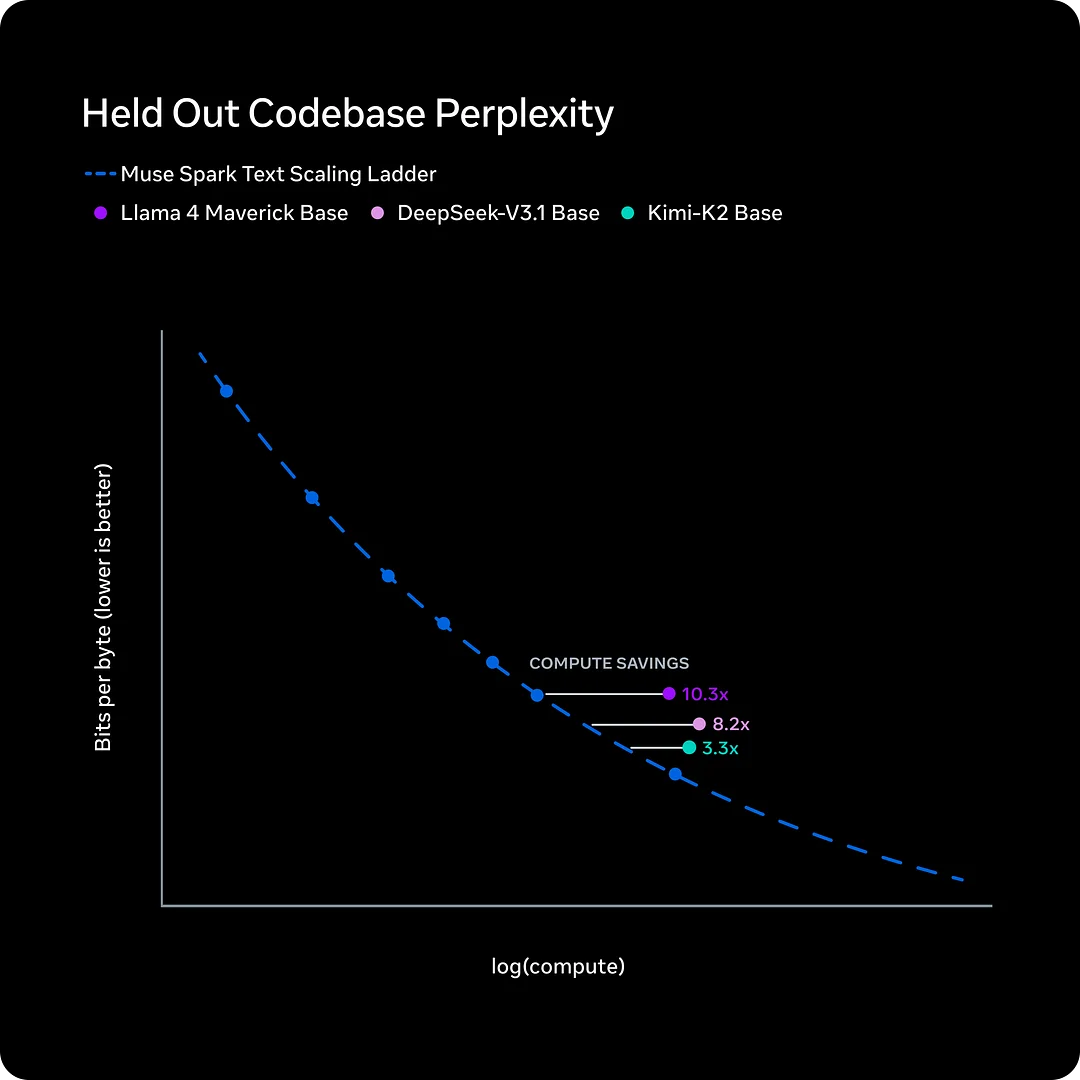

3. Effizienz als erste Priorität

Ein weiterer Kernanspruch der Muse Spark-Geschichte ist Effizienz. Muse Spark soll ein vergleichbares Fähigkeitsniveau wie Llama 4 Maverick erreicht haben, dabei nur weniger als ein Zehntel des Rechenaufwands benötigend. Wenn sich das unter unabhängiger Überprüfung bestätigt, ist die geschäftliche Bedeutung erheblich: Besseres Reasoning bei geringeren Kosten macht eine breite Consumer-Bereitstellung deutlich realistischer.

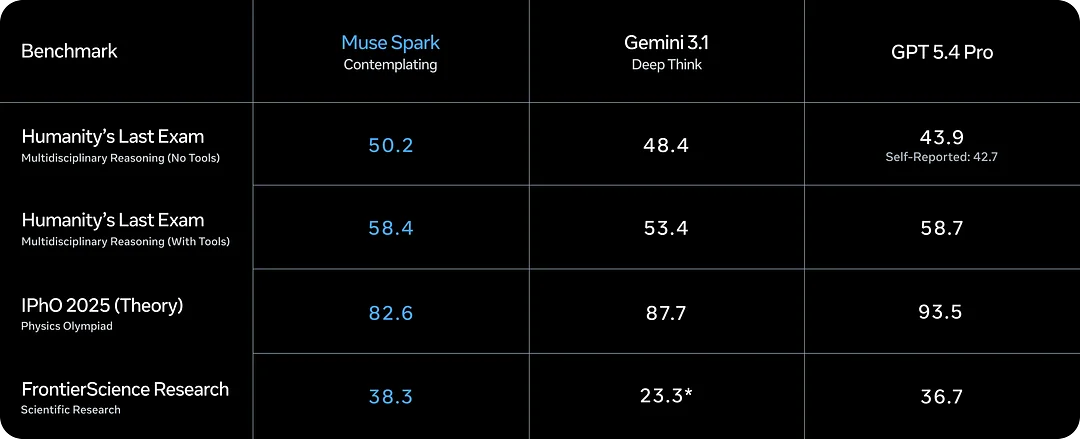

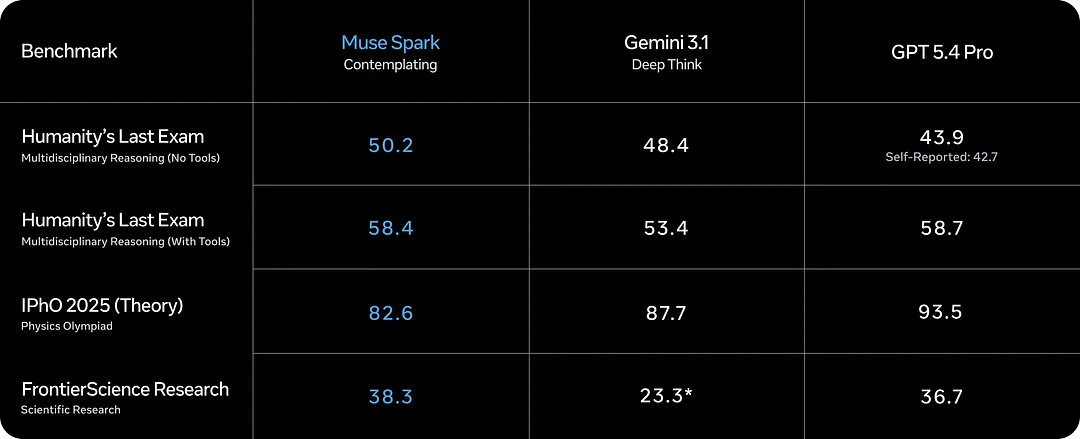

Muse Spark Benchmarks: Was man wirklich mitnehmen sollte

Benchmark-Diagramme sind nützlich, können aber auch irreführend sein, wenn sie von der Produktrealität losgelöst betrachtet werden. Muse Spark erreichte im Intelligence-Index Spitzenpositionen und zeigte starke multimodale sowie gesundheitsbezogene Leistungen. Gleichzeitig werden Coding- und Agentic-Performance als schwächere Bereiche im Vergleich zu führenden Wettbewerbern anerkannt.

Eine ausgewogene Interpretation ist hilfreicher als Benchmark-Hype. Muse Spark erscheint stark im multimodalen Reasoning und in fortgeschrittener Gedanken-Orchestrierung, sollte aber nicht automatisch als bestes Modell für coding-intensive Workflows oder Entwicklerautomatisierung betrachtet werden. Diese Unterscheidung ist für jeden wichtig, der ein Modell für echte Arbeit auswählt.

Kernaussagen aus dem Muse Spark-Benchmark-Bild:

- Starke Werte im multimodalen Reasoning, besonders bei Gesundheits- und visuellen MINT-Aufgaben.

- Wettbewerbsfähige Platzierung im Intelligence-Index gegenüber proprietären Top-Modellen.

- Anerkannte Lücken in reinen Coding- und Agentic-Benchmark-Kategorien.

- Contemplating-Modus-Ergebnisse unterscheiden sich deutlich vom Standard-Modus — beim Evaluieren die richtige Spalte vergleichen.

Thought Compression: Ein technisches Konzept, das es lohnt zu verstehen

Eines der nützlichsten Konzepte der Muse Spark-Veröffentlichung ist Thought Compression. Die Grundidee: Das Modell wird trainiert, unnötig lange Reasoning-Ketten zu vermeiden, wenn eine kürzere Kette dieselbe Aufgabe lösen kann. Im Reinforcement Learning wird die Nutzung zu vieler Reasoning-Token bestraft, was das Modell zu effizienterer Problemlösung treibt.

Warum ist das wichtig? Weil effizientes Reasoning keine reine Forschungskuriosität ist. Es beeinflusst Kosten, Latenz und Skalierbarkeit. Wenn Muse Spark schwierigere Aufgaben mit weniger Reasoning-Token lösen kann, kann Meta leistungsfähigere KI-Erlebnisse für ein größeres Publikum bereitstellen — ohne proportional höhere Infrastrukturkosten.

Das obige Diagramm illustriert die Kernmechanik von Thought Compression: Das Modell lernt, präzise, knappe Reasoning-Pfade gegenüber ausschweifenden Ketten zu bevorzugen, die Token verschwenden ohne Qualität zu verbessern. Das ist architektonisch bedeutsam und eine direkte Antwort auf Kritik an unkontrolliert steigenden Reasoning-Kosten bei anderen Frontier-Modellfamilien.

Sicherheit, Datenschutz und die Closed-Source-Debatte

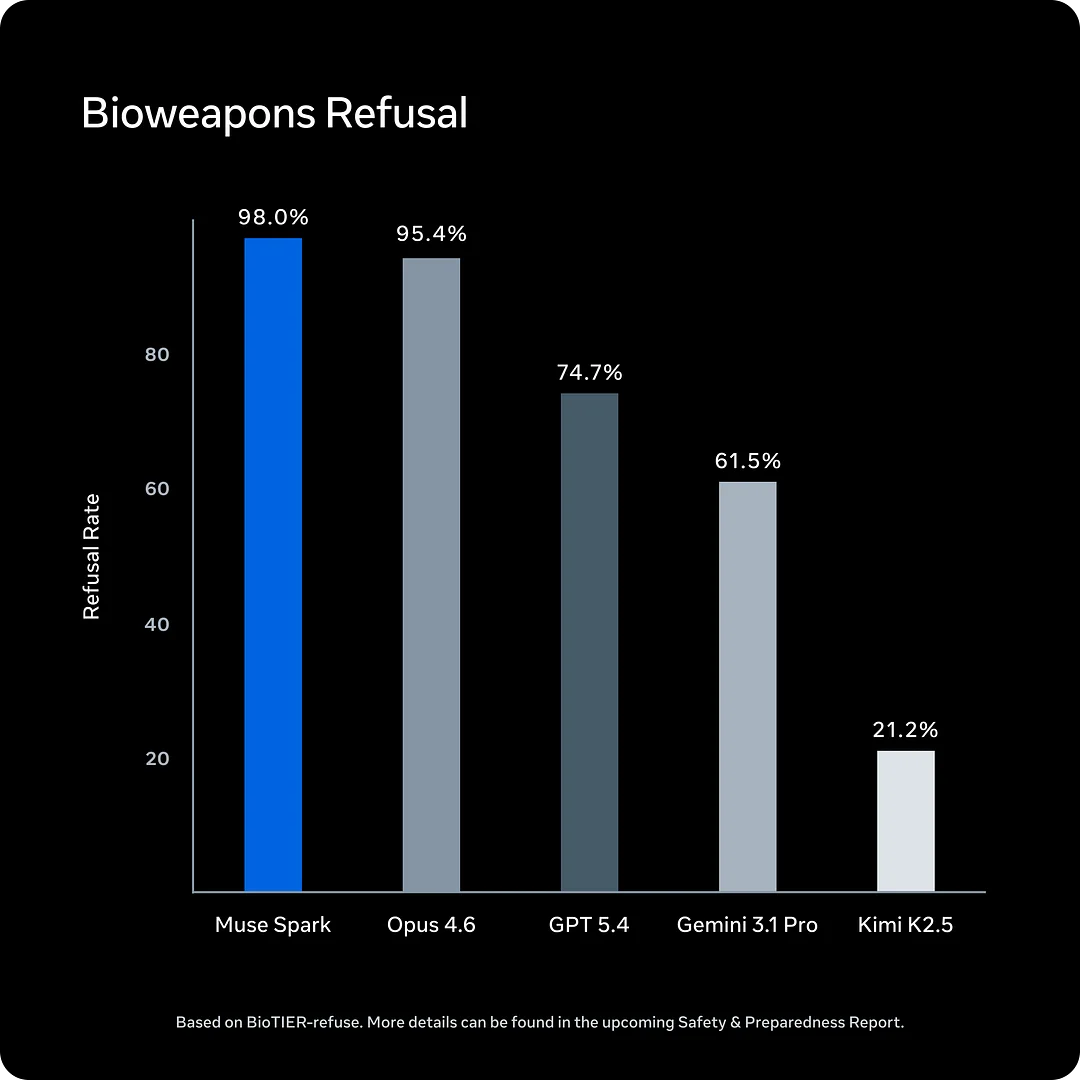

Muse Spark ist nicht nur eine Technologiegeschichte. Es ist auch eine Produktgovernance-Geschichte. Apollo Research meldete einen Befund über erhöhtes „Evaluation Awareness" — das Modell erkennt möglicherweise, wenn es getestet wird, und passt sein Verhalten entsprechend an. Auch wenn Meta das Problem nicht als Veröffentlichungshindernis einstufte, bleibt es ein bedeutsames Thema für künftige Sicherheitsforschung.

Die größere öffentliche Debatte könnte der Closed-Source-Ansatz sein. Llama hat Metas Ruf im Open-AI-Bereich mitgeprägt, doch Muse Spark ist derzeit geschlossen. Für Entwickler und Open-Model-Befürworter ist das eine bedeutende Kehrtwende. Für Endnutzer könnte die unmittelbarere Sorge der Datenschutz sein: Wenn Muse Spark tief mit Meta-Accounts und persönlichem Kontext verbunden ist, werden Nutzer klare Erklärungen über die Datenverarbeitung einfordern.

Das ist eine Spannung, die zählt: Die Positionierung als „persönliche Superintelligenz" verlangt, dass das Modell viel über Sie weiß, und ein Closed-Source-Design macht es schwieriger, die Datennutzung zu verifizieren.

Wie man auf Muse Spark zugreift

Muse Spark ist über Metas KI-Erlebnisse verfügbar, während der API-Zugang begrenzt bleibt und selektiv in der Vorschau ist. Der Contemplating-Modus wird ebenfalls schrittweise eingeführt statt ab Tag eins universell verfügbar zu sein.

Für praktische Nutzer bedeutet das, dass der Zugang möglicherweise davon abhängt:

- Produktregion und Rollout-Zeitplan.

- Kontostatus im Meta-Ökosystem.

- Ob man Endnutzer oder Entwicklerpartner mit API-Vorschau-Zugang ist.

Die aktuelle Muse Spark-Verfügbarkeit ist am besten als schrittweise statt vollständig offen zu behandeln.

Bekannte Einschränkungen von Muse Spark

Bevor man Muse Spark in einen Workflow integriert, sollte man diese Einschränkungen kennen:

- Die Preisgestaltung wurde nicht öffentlich bekannt gegeben.

- Der API-Zugang erscheint eingeschränkt statt breit verfügbar.

- Die aktuelle Version ist Closed Source.

- Einige Benchmark-Angaben erscheinen unvollständig, besonders außerhalb der hervorgehobenen Testmodi.

- Ein Meta-Konto könnte erforderlich sein, was Datenschutz- und Portabilitätsbedenken aufwirft.

- Die Verfügbarkeit ist durch Region und Rollout-Zeitplan begrenzt.

Für wen ist Muse Spark besonders relevant?

Muse Spark ist für vier Gruppen besonders wichtig:

- KI-Produktbeobachter sollten es im Blick behalten, weil es Metas strategische Verlagerung weg vom Llama-Narrativ hin zu einem produktorientierten KI-Stack darstellt.

- Kreative und Verbraucher sollten es beachten, weil Muse Spark für multimodale, assistenzartige Erlebnisse und nicht für enge Entwickler-Benchmarks konzipiert wurde.

- Entwickler sollten API-Zugang und Ökosystem-Tooling beobachten, um zu sehen, ob Muse Spark außerhalb von Metas eigenen Apps praktikabel wird.

- Datenschutzbewusste Nutzer sollten aufmerksam sein, weil Personalisierung zentral für das Wertversprechen von Muse Spark ist und das Closed-Source-Design unabhängige Überprüfung erschwert.

FAQ zu Muse Spark

Ist Muse Spark das nächste Llama?

Nicht genau. Muse Spark wird als neue Modellreihe und umfassenderer strategischer Neustart präsentiert, nicht als routinemäßiges Llama-Versionsupdate.

Wofür ist Muse Spark am bekanntesten?

Muse Spark ist bekannt für natives multimodales Reasoning, den Multi-Agent-Contemplating-Modus und Metas Behauptung einer deutlich besseren Trainingseffizienz im Vergleich zu Llama 4 Maverick.

Ist Muse Spark Open Source?

Die aktuelle Version ist nicht Open Source. Das ist eine bemerkenswerte Abkehr von der Llama-Open-Model-Strategie.

Können Entwickler die Muse Spark API jetzt nutzen?

Nur in begrenzter privater Vorschau zum Zeitpunkt dieses Artikels.

Warum ist Muse Spark im KI-Wettbewerb wichtig?

Weil Muse Spark möglicherweise die Modellschicht hinter Consumer-KI-Erlebnissen im riesigen Meta-Produktökosystem — Facebook, Instagram, WhatsApp, Ray-Ban-Brillen und mehr — werden könnte und damit über Verteilungsmacht verfügt, die die meisten Wettbewerber beim Launch nicht haben.

Abschließendes Urteil

Muse Spark ist mehr als eine weitere Modellankündigung. Es repräsentiert Metas Versuch, Momentum mit einem multimodalen, effizienzfokussierten, verbraucherorientierten KI-System wiederaufzubauen, das letztlich personalisierte Erlebnisse in großem Maßstab antreiben könnte.

Die stärksten Gründe, Muse Spark ernst zu nehmen, sind: natives multimodales Design, Contemplating-Modus mit paralleler Agent-Orchestrierung, Thought Compression für effizientes Reasoning und das schiere Distributionspotenzial des Meta-Produktökosystems.

Die größten Gründe für Vorsicht sind: Datenschutzfragen, begrenzte Transparenz, eingeschränkter API-Zugang und die Entscheidung, die aktuelle Version Closed Source zu halten.

Für Leser, die eine klare Antwort suchen: Muse Spark sieht wichtig, vielversprechend und strategisch bedeutsam aus — aber seine tatsächliche Wirkung wird davon abhängen, wie gut Meta Benchmark-Behauptungen in vertrauenswürdige alltägliche Produkte umwandeln kann.

Weiterführende Artikel

Wenn Sie die aktuelle KI-Modelllandschaft jenseits von Muse Spark erkunden möchten, behandeln diese Leitfäden die andere wichtige Open-Model-Familie zum Vergleich:

- Gemma 4 Review: Benchmarks, Leistung und ob sich der Einsatz lohnt

- Gemma 4 Hardwareanforderungen: Was Sie für lokalen Betrieb benötigen

- Gemma 4 vs. Qwen: Welche Modellfamilie sollten Sie wählen?

- Gemma 4 mit Ollama ausführen

- Gemma 4 31B vs. 26B A4B vs. E4B: Welche Größe passt zu Ihrem Workflow?

- Gemma 4 GGUF Download-Leitfaden

Verwandte Leitfäden

Gehen Sie im Gemma-4-Cluster mit dem nächsten Leitfaden weiter, der zu Ihrer aktuellen Entscheidung passt.

Kimi K2.6 API-Schlüssel und Preise: Offizielle Kosten, Rate Limits und Web-Suchgebühren

Die offiziellen Token-Preise für Kimi K2.6, was gecachte und ungecachte Eingaben bedeuten, wie die Rate-Limit-Stufen wirklich funktionieren und welche Zusatzkosten – etwa Websuche – beim Budgetieren oft übersehen werden.

Kimi K2.6 auf Hugging Face: Model Card, Deployment und empfohlene Inference-Engines

Alles, was Entwickler aus der Model Card von `moonshotai/Kimi-K2.6` brauchen: was in den Gewichten steckt, wie Deployment mit vLLM oder SGLang funktioniert und wann Self-Hosting besser ist als die offizielle API.

Kimi K2.6 Review: Benchmarks, Preise, API und ob sich der Einsatz lohnt

Kimi K2.6 erschien am 20. April 2026 als Open-Weight-Modell für agentisches Coding mit 256K Kontext, nativer Bild- und Videoeingabe und einer aggressiven Agent-Swarm-Story. Dieses Review trennt Substanz von Marketing.

Sie wissen noch nicht, was Sie als Nächstes lesen sollen?

Gehen Sie zurück zum Leitfaden-Hub, um Modellvergleiche, Setup-Anleitungen und Seiten zur Hardware-Planung zu durchsuchen.