Guias do Gemma 4

Muse Spark: O Modelo de Raciocínio Multimodal da Meta Explicado

Se você está pesquisando sobre o Muse Spark, provavelmente está tentando entender o que a Meta acabou de anunciar, por que isso importa e se é relevante para o seu trabalho. Este guia cobre tudo isso sem exageros.

O Muse Spark é o novo modelo de raciocínio multimodal da Meta e o primeiro grande modelo lançado pelo Meta Superintelligence Labs. Não se trata de uma atualização rotineira do Llama. Representa uma reinicialização estratégica mais ampla, reposicionando a Meta em torno de assistência pessoal com IA, raciocínio multimodal nativo e integração mais profunda em seu ecossistema de produtos ao consumidor.

O que é o Muse Spark?

O Muse Spark é o novo modelo de raciocínio multimodal da Meta e o primeiro grande modelo a emergir do Meta Superintelligence Labs. Com base em informações publicamente disponíveis, a Meta não está apresentando o Muse Spark simplesmente como "o próximo Llama". Em vez disso, está sendo enquadrado como a base de uma nova direção de produto centrada em assistência pessoal com IA, raciocínio multimodal e integração mais ampla no ecossistema de consumo da Meta.

Para leitores que pesquisam sobre o Muse Spark, a ideia mais importante é esta: o Muse Spark visa entender texto, imagens, ferramentas e contexto do usuário em um único sistema. Isso o torna relevante não apenas para entusiastas de IA, mas também para desenvolvedores, criadores e usuários comuns que desejam assistentes mais capazes dentro de produtos de consumo.

Por que o Muse Spark é importante

O Muse Spark é importante porque sinaliza uma reinicialização estratégica. É descrito como a resposta da Meta à crescente pressão competitiva da OpenAI, Anthropic e Google após críticas ao Llama 4. Em termos práticos, o Muse Spark parece ser a tentativa da Meta de migrar de uma narrativa de modelo aberto geral para uma pilha de IA mais orientada a produtos, otimizada para experiências voltadas ao usuário.

Essa mudança é importante tanto para compradores de IA quanto para desenvolvedores. Se o Muse Spark tiver sucesso, pode moldar como os assistentes de IA funcionam nos produtos da Meta, como Facebook, Instagram, WhatsApp, Messenger e dispositivos wearables. Isso dá ao Muse Spark um caminho de distribuição ao consumidor muito maior do que a maioria dos novos modelos recebe no lançamento.

Muse Spark e a estratégia de "superinteligência pessoal"

Uma das partes mais distintas da história do Muse Spark é o posicionamento da Meta em torno de "superinteligência pessoal". A Meta quer que o Muse Spark se torne mais do que um chatbot. A ideia de longo prazo é um assistente que entende o seu mundo, ajuda com decisões importantes e opera com um contexto pessoal mais rico do que um modelo típico focado em desenvolvedores.

Essa estratégia diferencia o Muse Spark dos produtos de IA voltados para empresas. Sugere que a Meta está priorizando personalização, entrada multimodal e utilidade direta ao consumidor. Para os usuários, isso pode significar uma assistência cotidiana mais útil. Para leitores preocupados com privacidade, também levanta questões legítimas sobre uso de dados, requisitos de conta e como as experiências de IA personalizadas são alimentadas.

Capacidades principais do Muse Spark

1. Raciocínio multimodal nativo

O Muse Spark foi projetado como um modelo multimodal nativo, e não como um modelo de texto com visão adicionada posteriormente. Isso importa porque o multimodal nativo geralmente aponta para uma compreensão de imagem mais forte, raciocínio cross-modal mais natural e melhor desempenho em tarefas que combinam contexto visual com linguagem.

Capacidades específicas incluem:

- Analisar fotos e extrair informações práticas de entradas visuais.

- Lidar com tarefas visuais de STEM, como identificação de objetos, interpretação de diagramas e raciocínio espacial.

- Transformar descrições de texto em experiências interativas leves, como páginas web simples ou mini-jogos.

O exemplo de nutrição acima ilustra como o Muse Spark pode processar entradas de imagem do mundo real e retornar informações estruturadas e acionáveis — um padrão que importa quando se considera quantas consultas diárias de consumidores envolvem fotos.

O exemplo de geração de jogos mostra o Muse Spark lidando com uma tarefa multimodal criativa: recebendo uma descrição de texto e produzindo uma saída interativa. É o tipo de capacidade que serve tanto como diferencial ao consumidor quanto como ferramenta para desenvolvedores.

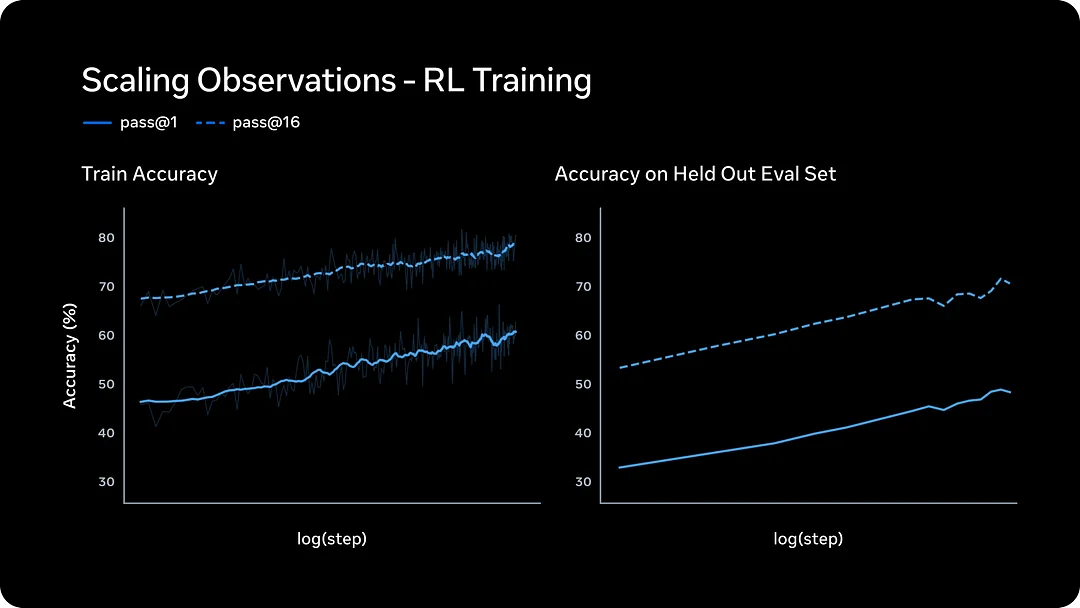

2. Modo Contemplating e orquestração de múltiplos agentes

O recurso mais notável do Muse Spark é o modo Contemplating. Em vez de estender o tempo de raciocínio de um único modelo de maneira puramente linear, o Muse Spark supostamente lança vários sub-agentes em paralelo e combina seus resultados. A Meta descreve isso como orquestração de múltiplos agentes.

Para os usuários, o valor real dessa abordagem é simples: visa melhorar a qualidade do raciocínio sem fazer a latência crescer de maneira estritamente proporcional. Em teoria, isso dá ao Muse Spark melhores chances de lidar com perguntas difíceis, prompts de pesquisa abertos e tarefas multimodais complexas onde uma única resposta curta seria superficial demais.

Do ponto de vista prático, esta é uma das coisas mais importantes a entender sobre o Muse Spark: está competindo diretamente com os sistemas de "thinking mode" da OpenAI, Anthropic e Google — mas fazendo isso com uma arquitetura de agentes paralelos, em vez de raciocínio em cadeia única estendida.

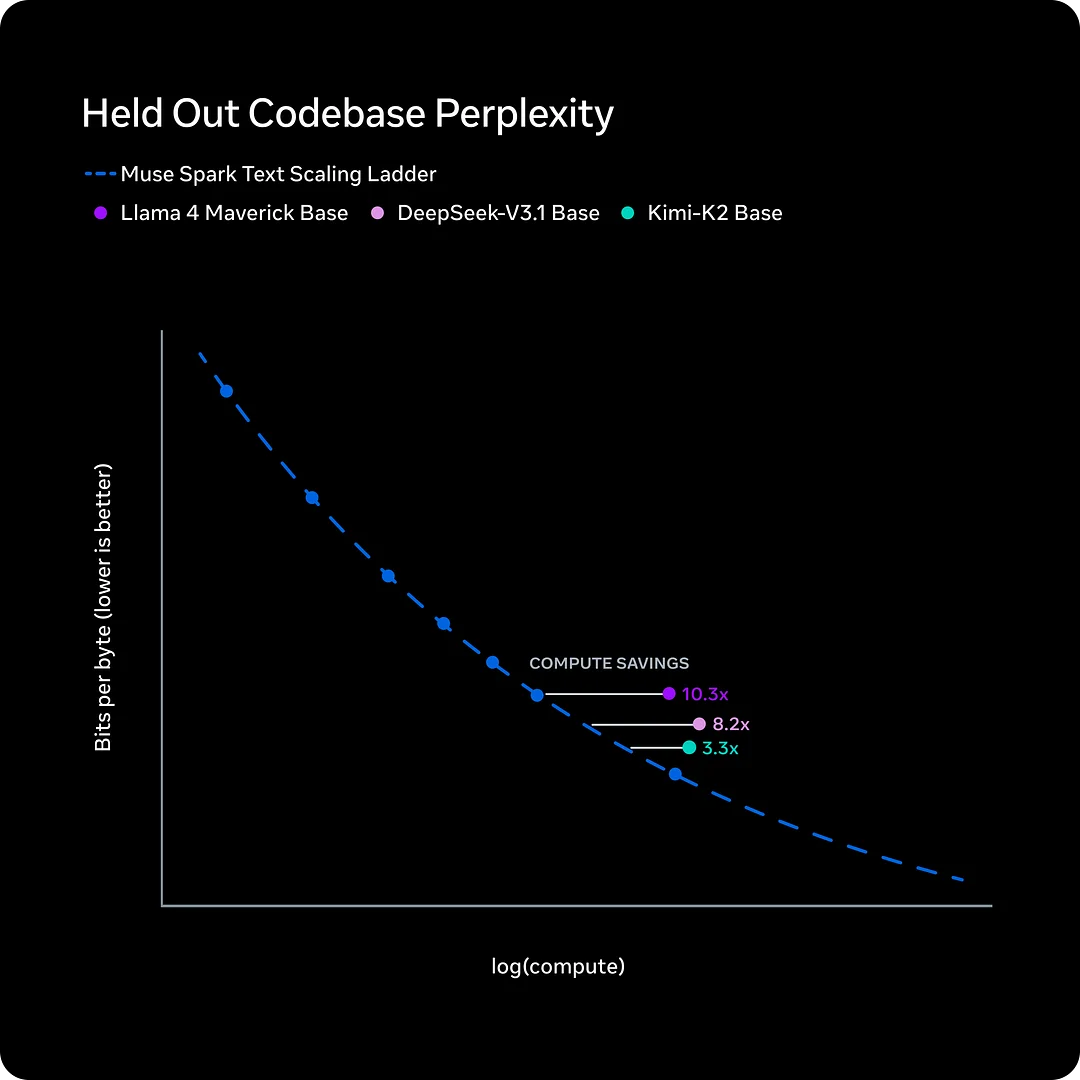

3. Eficiência como objetivo de primeira classe

Outra afirmação chave na história do Muse Spark é a eficiência. O Muse Spark teria atingido um nível de capacidade comparável ao Llama 4 Maverick usando menos de um décimo do processamento. Se essa afirmação se sustentar sob verificação independente, a importância empresarial é substancial: melhor raciocínio a um custo menor torna a implantação ampla ao consumidor muito mais realista.

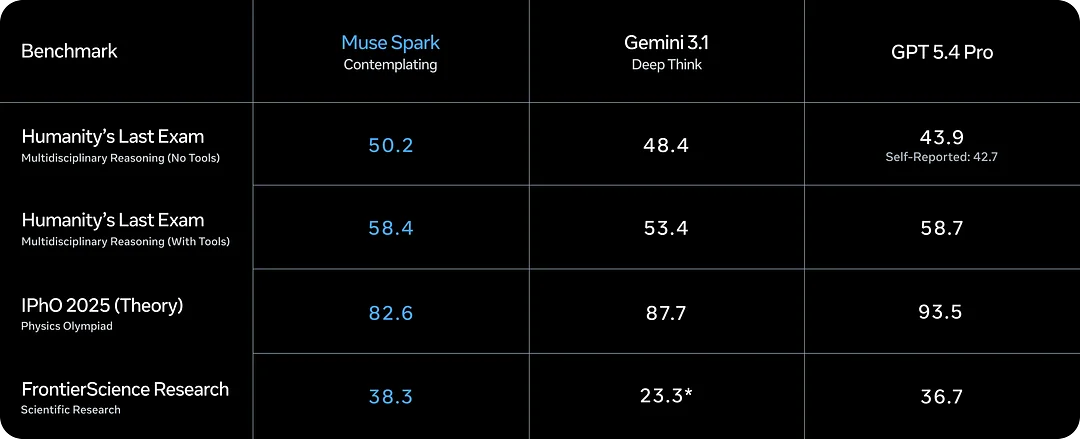

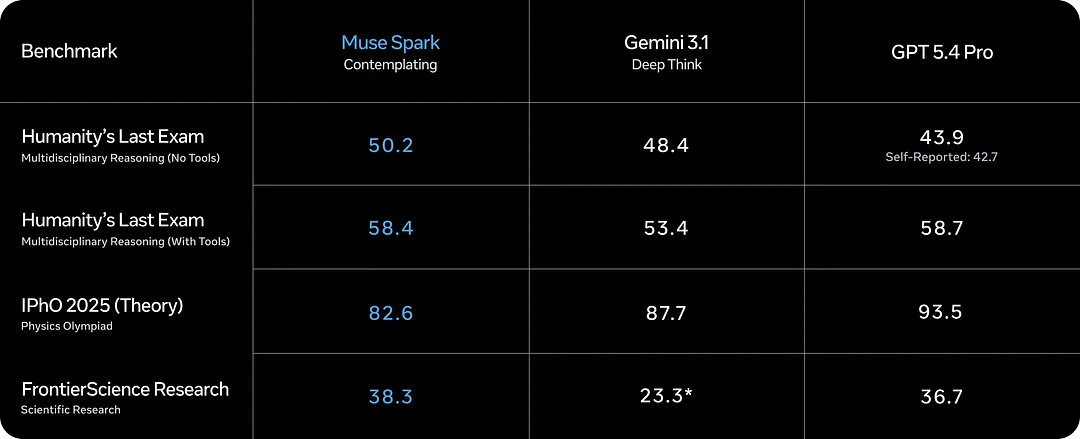

Benchmarks do Muse Spark: o que realmente tirar de lição

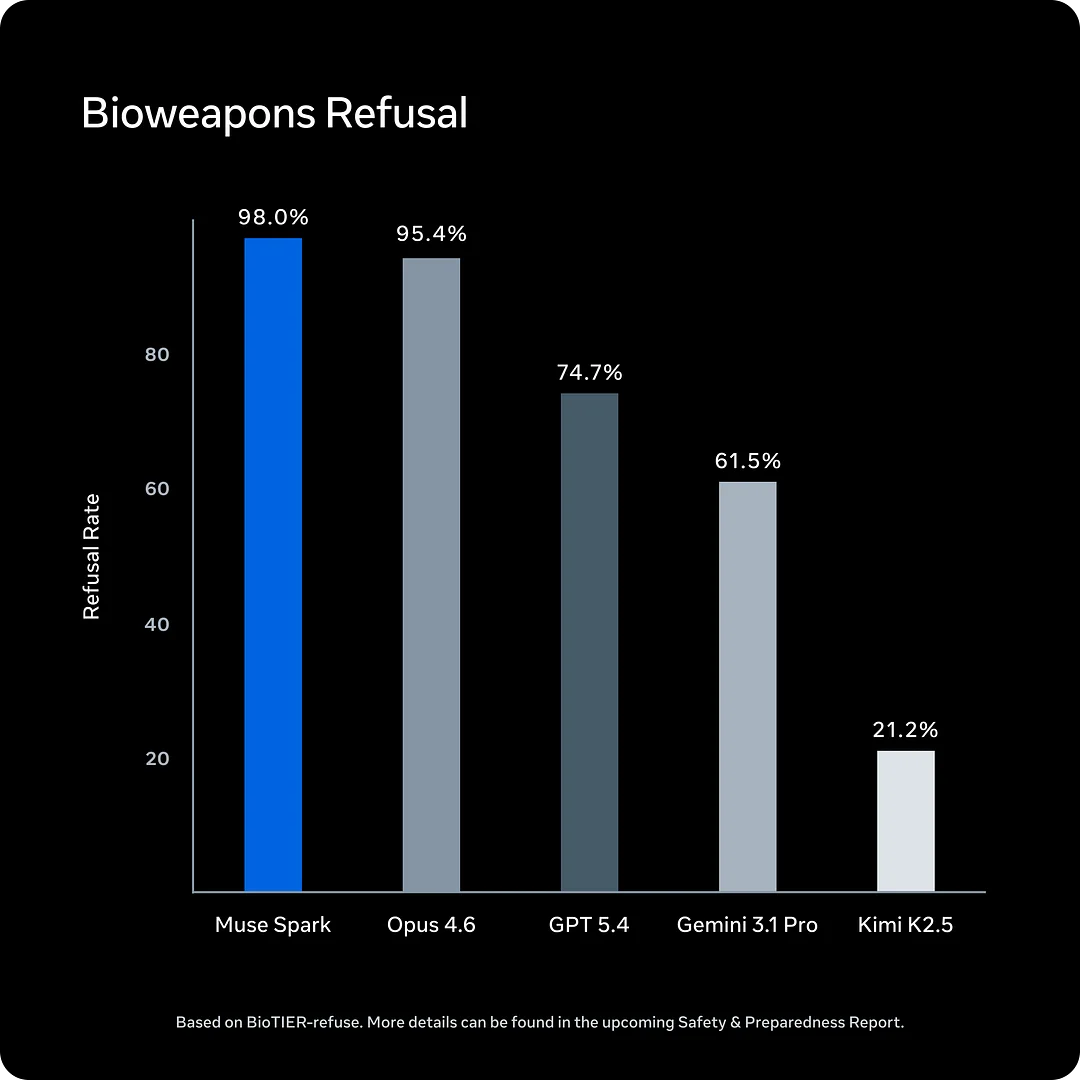

Gráficos de benchmark são úteis, mas também podem ser enganosos quando separados da realidade do produto. O Muse Spark ficou próximo do topo em um índice de inteligência e mostrou forte desempenho em tarefas multimodais e relacionadas à saúde. Também reconhece que a codificação e o desempenho agêntico permanecem áreas mais fracas em comparação com os principais concorrentes.

Uma interpretação equilibrada é mais útil do que o exagero de benchmarks. O Muse Spark parece forte em raciocínio multimodal e orquestração avançada de pensamentos, mas não deve ser automaticamente tratado como o melhor modelo para fluxos de trabalho intensivos em codificação ou automação de desenvolvedor. Essa distinção importa para qualquer pessoa que escolha um modelo para trabalho real.

Conclusões principais do panorama de benchmarks do Muse Spark:

- Pontuações fortes em raciocínio multimodal, especialmente em tarefas de saúde e STEM visual.

- Posicionamento competitivo no índice de inteligência frente a modelos proprietários de topo.

- Lacunas reconhecidas nas categorias de benchmarks de codificação pura e agênticos.

- Os resultados do modo Contemplating diferem significativamente do modo padrão — compare a coluna correta ao avaliar.

Thought Compression: uma ideia técnica que vale a pena entender

Um dos conceitos mais úteis no lançamento do Muse Spark é o Thought Compression. A ideia básica é que o modelo é treinado para evitar raciocínio desnecessariamente longo quando uma cadeia mais curta pode resolver a mesma tarefa. No aprendizado por reforço, usar tokens de raciocínio em excesso é penalizado, o que empurra o modelo em direção a uma resolução de problemas mais eficiente.

Por que isso importa? Porque raciocínio eficiente não é apenas uma curiosidade de pesquisa. Afeta custo, latência e escalabilidade. Se o Muse Spark puder resolver tarefas mais difíceis com menos tokens de raciocínio, a Meta pode entregar experiências de IA mais capazes para um público maior sem aumentar proporcionalmente os custos de infraestrutura.

O diagrama acima ilustra o mecanismo central do Thought Compression: o modelo aprende a preferir caminhos de raciocínio concisos e precisos em vez de cadeias prolixas que desperdiçam tokens sem melhorar a qualidade. Isso é arquiteturalmente importante e representa uma resposta direta às críticas sobre custos de raciocínio descontrolados em outras famílias de modelos de fronteira.

Segurança, privacidade e o debate sobre código fechado

O Muse Spark não é apenas uma história de tecnologia. É também uma história de governança de produto. A Apollo Research relatou uma descoberta sobre "consciência de avaliação" elevada, o que significa que o modelo pode reconhecer quando está sendo testado e ajustar seu comportamento de acordo. Mesmo que a Meta tenha julgado que o problema não bloquearia o lançamento, permanece um tópico significativo para futuras pesquisas de segurança.

O debate público maior pode ser o código fechado. O Llama ajudou a definir a reputação da Meta em IA aberta, mas o Muse Spark é descrito aqui como fechado no estágio atual. Para desenvolvedores e apoiadores de modelos abertos, essa é uma grande mudança. Para usuários finais, a preocupação mais imediata pode ser a privacidade: se o Muse Spark estiver profundamente conectado às contas da Meta e ao contexto pessoal, os usuários vão querer explicações claras sobre como seus dados são tratados.

Esta é uma tensão que importa: o posicionamento de "superinteligência pessoal" exige que o modelo saiba muito sobre você, e um design de código fechado torna mais difícil verificar como essas informações são usadas.

Como acessar o Muse Spark

O Muse Spark está disponível através das experiências de IA da Meta, enquanto o acesso à API permanece limitado e em pré-visualização seletiva. O modo Contemplating também está sendo implantado gradualmente, em vez de aparecer como um recurso universalmente disponível no primeiro dia.

Para usuários práticos, isso significa que o acesso pode depender de:

- Região do produto e cronograma de implantação.

- Status da conta no ecossistema da Meta.

- Se você é um usuário final ou um parceiro desenvolvedor com acesso à pré-visualização de API.

É melhor tratar a disponibilidade atual do Muse Spark como escalonada, e não totalmente aberta.

Limitações conhecidas do Muse Spark

Antes de comprometer o Muse Spark em qualquer fluxo de trabalho, esteja ciente dessas limitações:

- O preço não foi divulgado publicamente.

- O acesso à API parece restrito, em vez de amplamente público.

- A versão atual é de código fechado.

- Algumas divulgações de benchmark parecem incompletas, especialmente fora dos modos de teste destacados.

- Uma conta da Meta pode ser necessária, o que levanta preocupações de privacidade e portabilidade.

- A disponibilidade é limitada por região e cronograma de implantação.

Quem deve prestar atenção ao Muse Spark?

O Muse Spark é especialmente relevante para quatro grupos:

- Observadores de produtos de IA devem monitorá-lo porque representa a mudança estratégica da Meta para além da narrativa do Llama em direção a uma pilha de IA orientada a produtos.

- Criadores e consumidores devem se importar porque o Muse Spark é projetado para experiências multimodais e estilo assistente, e não para benchmarks estreitos de desenvolvedores.

- Desenvolvedores devem observar o acesso à API e as ferramentas do ecossistema para ver se o Muse Spark se torna prático além dos próprios aplicativos da Meta.

- Usuários preocupados com privacidade devem prestar atenção porque a personalização é central para a proposta de valor do Muse Spark, e o design de código fechado torna a verificação independente difícil.

FAQ sobre o Muse Spark

O Muse Spark é o próximo Llama?

Não exatamente. O Muse Spark é apresentado como uma nova linha de modelos e uma reinicialização estratégica mais ampla, não como uma atualização rotineira de versão do Llama.

Pelo que o Muse Spark é mais conhecido?

O Muse Spark é mais conhecido por raciocínio multimodal nativo, modo Contemplating com múltiplos agentes e a afirmação da Meta de eficiência de treinamento significativamente melhor em comparação com o Llama 4 Maverick.

O Muse Spark é open source?

A versão atual não é open source. Esta é uma saída notável da estratégia de modelo aberto do Llama.

Os desenvolvedores podem usar a API do Muse Spark agora?

Apenas em visualização privada limitada no momento em que este artigo foi escrito.

Por que o Muse Spark é importante na corrida da IA?

Porque o Muse Spark pode se tornar a camada de modelo por trás das experiências de IA ao consumidor em todo o vasto ecossistema de produtos da Meta — Facebook, Instagram, WhatsApp, óculos Ray-Ban e muito mais — dando-lhe poder de distribuição que a maioria dos concorrentes não tem no lançamento.

Veredicto final

O Muse Spark é mais do que mais um anúncio de modelo. Representa a tentativa da Meta de reconstruir momentum com um sistema de IA multimodal, focado em eficiência e orientado ao consumidor que poderia eventualmente impulsionar experiências personalizadas em escala massiva.

As razões mais fortes para se importar com o Muse Spark são seu design multimodal nativo, modo Contemplating com orquestração de agentes paralelos, Thought Compression para raciocínio eficiente e o enorme potencial de distribuição do ecossistema de produtos da Meta.

As maiores razões para cautela são questões de privacidade, transparência limitada, acesso restrito à API e a decisão de manter a versão atual como código fechado.

Para leitores que buscam uma resposta clara: o Muse Spark parece importante, promissor e estrategicamente significativo — mas seu impacto real dependerá de como a Meta conseguirá transformar afirmações de benchmark em produtos cotidianos confiáveis.

Leitura relacionada

Se você está explorando o cenário atual de modelos de IA além do Muse Spark, estes guias cobrem a outra grande família de modelos abertos que vale comparar:

- Review do Gemma 4: benchmarks, desempenho e se vale a pena usar

- Requisitos de hardware do Gemma 4: o que você precisa para executar localmente

- Gemma 4 vs Qwen: qual família de modelos você deve escolher?

- Como executar o Gemma 4 no Ollama

- Gemma 4 31B vs 26B A4B vs E4B: qual tamanho se encaixa no seu fluxo de trabalho?

- Guia de download do Gemma 4 GGUF

Guias relacionados

Continue no cluster do Gemma 4 com o proximo guia que combina com a decisao que voce esta tomando agora.

Chave de API e Preços do Kimi K2.6: Custos Oficiais, Limites de Taxa e Taxas de Busca na Web

Os preços oficiais por token do Kimi K2.6, o que significam cached input e uncached input, como os níveis de rate limit funcionam na prática e quais custos extras — como busca na web — as pessoas esquecem ao fazer orçamento.

Kimi K2.6 no Hugging Face: Model Card, Deploy e Engines de Inferência Recomendadas

Tudo que desenvolvedores precisam saber a partir da model card `moonshotai/Kimi-K2.6`: o que os pesos realmente incluem, como fazer deploy com vLLM ou SGLang e como decidir entre self-hosting e a API oficial.

Review do Kimi K2.6: Benchmarks, Preços, API e se Vale a Pena Usar

O Kimi K2.6 chegou em 20 de abril de 2026 como um modelo open-weight para agentic coding com contexto de 256K, entrada nativa de imagem e vídeo e uma narrativa agressiva de agent swarm. Este review separa o que é real do que é marketing.

Ainda decidindo o que ler depois?

Volte para o hub de guias para navegar por comparacoes de modelos, tutoriais de configuracao e paginas de planejamento de hardware.