Gemma 4 E2B vs E4B: Qual Modelo Pequeno Você Deve Escolher?

Um guia prático sobre o Gemma 4 E2B vs E4B para quem está escolhendo entre os dois modelos pequenos, com lacunas reais de benchmark e orientações de memória.

Guias do Gemma 4

Tutoriais de configuracao local, tabelas de requisitos de hardware e orientacao de escolha de modelo para quem esta avaliando o Gemma 4.

Se voce vai ler apenas algumas paginas primeiro, comece pela escolha do modelo, pelo planejamento de hardware e pelas duvidas de configuracao ou comparacao mais comuns.

Um guia prático sobre o Gemma 4 E2B vs E4B para quem está escolhendo entre os dois modelos pequenos, com lacunas reais de benchmark e orientações de memória.

Uma comparação prática do Gemma 4 26B vs 31B para quem está decidindo entre o ponto ideal do MoE e o modelo denso mais forte da família.

Uma calculadora de VRAM e seletor de modelos funcional para o Gemma 4, construídos a partir de dados oficiais de memória, para que você possa escolher o modelo certo antes de baixar qualquer coisa.

Comparacoes da familia de modelos e guias de escolha de versao para quem esta decidindo qual caminho seguir com o Gemma 4.

Dois dos modelos open-weight mais fortes de 2026 vindos da China, lançados com duas semanas de diferença e mirando workloads parecidos de coding — mas com diferenças reais em modalidade, contexto e estrutura de preço.

Decifre o sistema de nomenclatura do Gemma 4, compare benchmarks em todas as quatro variantes e encontre o modelo certo para o seu hardware antes de baixar qualquer coisa.

Gemma 4 vs Qwen não é uma pergunta com uma única resposta definitiva. Este guia ajuda você a decidir com base no seu fluxo de trabalho, hardware, implantação e ecossistema.

Tutoriais praticos para Ollama, LM Studio, llama.cpp, Google AI Studio e fluxos relacionados ao Gemma 4.

Os preços oficiais por token do Kimi K2.6, o que significam cached input e uncached input, como os níveis de rate limit funcionam na prática e quais custos extras — como busca na web — as pessoas esquecem ao fazer orçamento.

Tudo que desenvolvedores precisam saber a partir da model card `moonshotai/Kimi-K2.6`: o que os pesos realmente incluem, como fazer deploy com vLLM ou SGLang e como decidir entre self-hosting e a API oficial.

O Kimi K2.6 chegou em 20 de abril de 2026 como um modelo open-weight para agentic coding com contexto de 256K, entrada nativa de imagem e vídeo e uma narrativa agressiva de agent swarm. Este review separa o que é real do que é marketing.

Um guia prático para usar o Kimi K2.6 no Ollama com a entrada oficial `kimi-k2.6:cloud` — comandos de setup, integrações com agentes de código e o que significa usar o Ollama com backend em nuvem.

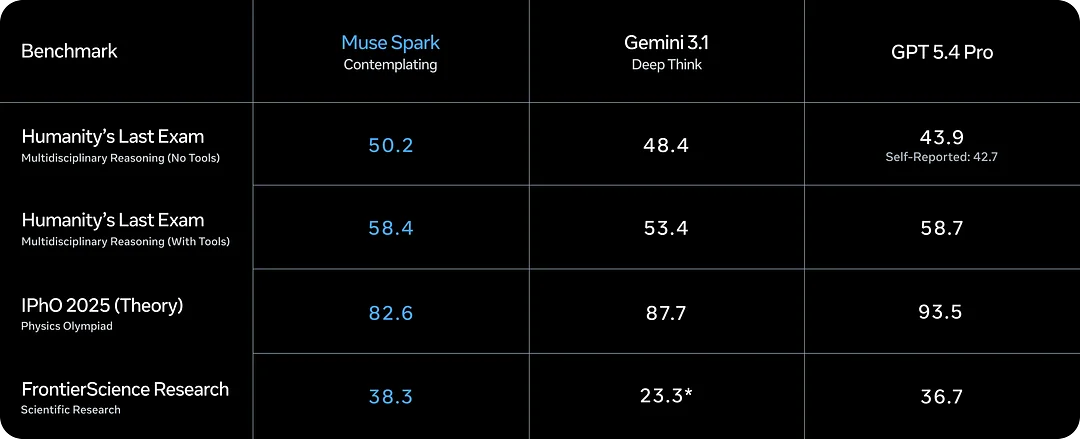

Muse Spark é o novo modelo de IA da Meta, lançado pelo Meta Superintelligence Labs. Este guia cobre capacidades, modo Contemplating, benchmarks e o que verificar antes de adotá-lo.

Uma resposta prática sobre se o llama.cpp suporta o Gemma 4, com links oficiais do GGUF, status de suporte atual e o que 'suportado' realmente significa.

Uma resposta clara sobre se o LM Studio suporta o Gemma 4, com a lista de modelos suportados, memória mínima e expectativas práticas de configuração.

Uma resposta prática sobre se o Unsloth suporta o Gemma 4, cobrindo suporte para execução local, suporte para ajuste fino e as ressalvas específicas do modelo que importam.

Um guia prático sobre o Gemma 4 no iPhone cobrindo configuração no iOS, escolha do modelo, compatibilidade do dispositivo, uso offline e que desempenho esperar.

Use este guia de API do Gemma 4 para criar um endpoint local compatível com a OpenAI, testá-lo rapidamente e escolher o runtime certo para o seu fluxo de trabalho.

Um guia prático de configuração do Gemma 4 no Windows cobrindo verificações de hardware, Ollama, LM Studio, escolha do modelo e os problemas mais comuns no Windows.

Use este guia passo a passo para fazer ajuste fino do Gemma 4 com Unsloth, escolher o modelo certo para o seu hardware e exportar o resultado para Ollama, llama.cpp ou LM Studio.

Use este guia de download do Gemma 4 GGUF para escolher uma fonte confiável, selecionar o arquivo correto e ir do download à primeira resposta local com menos tentativa e erro.

Use este review do Gemma 4 para entender a família de modelos, os números de benchmark mais importantes do Gemma 4 e os compromissos reais de implantação antes de se comprometer.

Se você quer saber o que é o Gemma 4, este guia explica o lançamento, tamanhos de modelos, limites de contexto, licenciamento e as maneiras mais fáceis de começar.

O Google AI Studio é uma das formas mais rápidas de avaliar o acesso hospedado ao Gemma 4, especialmente se você ainda não estiver pronto para se comprometer com uma configuração local.

Use este guia para entender onde o Unsloth se encaixa em um fluxo de trabalho com o Gemma 4 e o que decidir antes de mergulhar no ajuste fino.

Um guia prático de LM Studio para o Gemma 4, focado em escolha de modelo, compatibilidade de hardware, fluxo de trabalho inicial e o que verificar antes de culpar o modelo.

Tudo o que você precisa para rodar o Gemma 4 localmente com o llama.cpp: tabelas de hardware, comandos de build prontos para copiar e colar, guia de quantização e configuração multimodal.

Paginas de requisitos de hardware e guias de planejamento por maquina para evitar baixar o modelo errado logo no inicio.

Um guia focado nos requisitos de VRAM do Gemma 4 26B A4B com tamanhos exatos de GGUF, faixas de planejamento e por que o 26B é o ponto ideal para uso local.

Um guia focado nos requisitos de VRAM do Gemma 4 31B com tamanhos exatos de GGUF, faixas de planejamento e conselhos realistas sobre qual hardware faz sentido.

Um guia focado nos requisitos de VRAM do Gemma 4 E2B com tamanhos exatos de arquivo, faixas de planejamento prático e conselhos realistas sobre quando o E2B é a escolha certa.

Um guia focado nos requisitos de VRAM do Gemma 4 E4B com tamanhos exatos, faixas de planejamento e conselhos práticos para IA local em laptops.

Se você quer saber se um Mac mini pode rodar o Gemma 4, a resposta real depende de qual modelo Gemma 4 você pretende usar e de qual tipo de experiência você espera.

Um guia prático de hardware para o Gemma 4 com a tabela oficial de memória aproximada e conselhos simples sobre qual modelo experimentar primeiro.

O caminho mais rápido para colocar o Gemma 4 em funcionamento localmente: a tag certa, a verificação correta de hardware e o comando ideal — sem perder tempo com o modelo errado.