Guias do Gemma 4

Guia de Download do Gemma 4 GGUF: Fontes Seguras, Dicas de Quantização e Configuração Local

Se você precisa de um download do Gemma 4 GGUF, você já passou da fase de "o que é este modelo?". Você quer a maneira mais segura de baixar o Gemma 4, escolher a quantização certa e colocar uma execução local para funcionar sem perder horas.

Este guia foi construído para esse objetivo exato. Ele cobre fontes confiáveis, quando usar repositórios do Gemma 4 no Hugging Face, como rodar builds GGUF no llama.cpp e quando o Ollama é o caminho mais simples.

Download do Gemma 4 GGUF: comece pelo arquivo certo, não pelo maior arquivo

O maior erro em qualquer fluxo de trabalho GGUF é assumir que o maior arquivo é automaticamente o melhor.

Antes de baixar o Gemma 4, decida qual membro da família de modelos realmente cabe na sua máquina:

- E2B se você precisar do ponto de entrada mais leve

- E4B se você quiser a melhor primeira execução local equilibrada

- 26B A4B se você deseja saídas mais fortes e se preocupa com a eficiência

- 31B se você quer o modelo denso de mais alto nível

Em seguida, escolha a quantização com base na memória. O caminho GGUF só é útil se o arquivo que você escolher puder rodar confortavelmente no seu hardware.

Se você ainda precisar de ajuda para escolher o modelo, leia O que é o Gemma 4? primeiro.

O que é o Gemma 4 GGUF?

Uma configuração do Gemma 4 GGUF oferece um formato de modelo binário amigável ao llama.cpp, projetado para inferência local eficiente e empacotamento ciente de metadados.

Na prática, o Gemma 4 GGUF é importante porque é o formato que a maioria dos usuários locais deseja quando precisa de:

- Compatibilidade com llama.cpp

- Arquivos quantizados para orçamentos de memória menores

- Um caminho direto para implantação em linha de comando (CLI) local ou servidor local

Para muitos desenvolvedores locais, o Gemma 4 GGUF é a ponte mais prática entre a disponibilidade do modelo e um fluxo de trabalho auto-hospedado utilizável.

Se o seu objetivo é o controle local, a rota GGUF costuma ser o caminho mais rápido.

Fontes confiáveis para download do Gemma 4 GGUF

Nem toda fonte GGUF carrega o mesmo nível de confiança.

Aqui está a hierarquia prática de fontes:

| Fonte | O que você recebe | Melhor uso |

|---|---|---|

| ggml-org no Hugging Face | Repositórios GGUF de estilo oficial alinhados com o uso do llama.cpp | Melhor ponto de partida para usuários do llama.cpp |

| Biblioteca Ollama | Instalação local gerenciada de builds do Gemma 4 | Melhor ponto de partida pela simplicidade |

| bartowski no Hugging Face | Muitos arquivos GGUF da comunidade quantizados | Melhor quando você precisa de mais opções de quantização |

| Pesos oficiais do Google / Kaggle | Safetensors e contexto de distribuição de primeira mão | Melhor para verificações de procedência, não para uso direto de GGUF |

Se a sua principal preocupação é a procedência, comece sua pesquisa pelos canais oficiais do Google Gemma 4 e depois vá para o ecossistema confiável do llama.cpp. Se a sua principal preocupação é a conveniência, o Ollama costuma ser uma resposta melhor do que um download manual do Gemma 4.

Opções do Gemma 4 no Hugging Face

Para muitos leitores, o caminho GGUF mais prático começa nos repositórios do Gemma 4 no Hugging Face.

Você geralmente tem dois caminhos no Hugging Face:

- Use os repositórios da ggml-org para uma rota GGUF mais direta e amigável ao llama.cpp

- Use repositórios de quantização da comunidade, como o do bartowski, quando precisar de um arquivo específico como

Q4_K_M

É por isso que o termo Gemma 4 Hugging Face é tão importante na configuração local. Não é apenas onde você navega. É onde você decide se quer um alinhamento de estilo oficial ou opções de quantização mais amplas da comunidade.

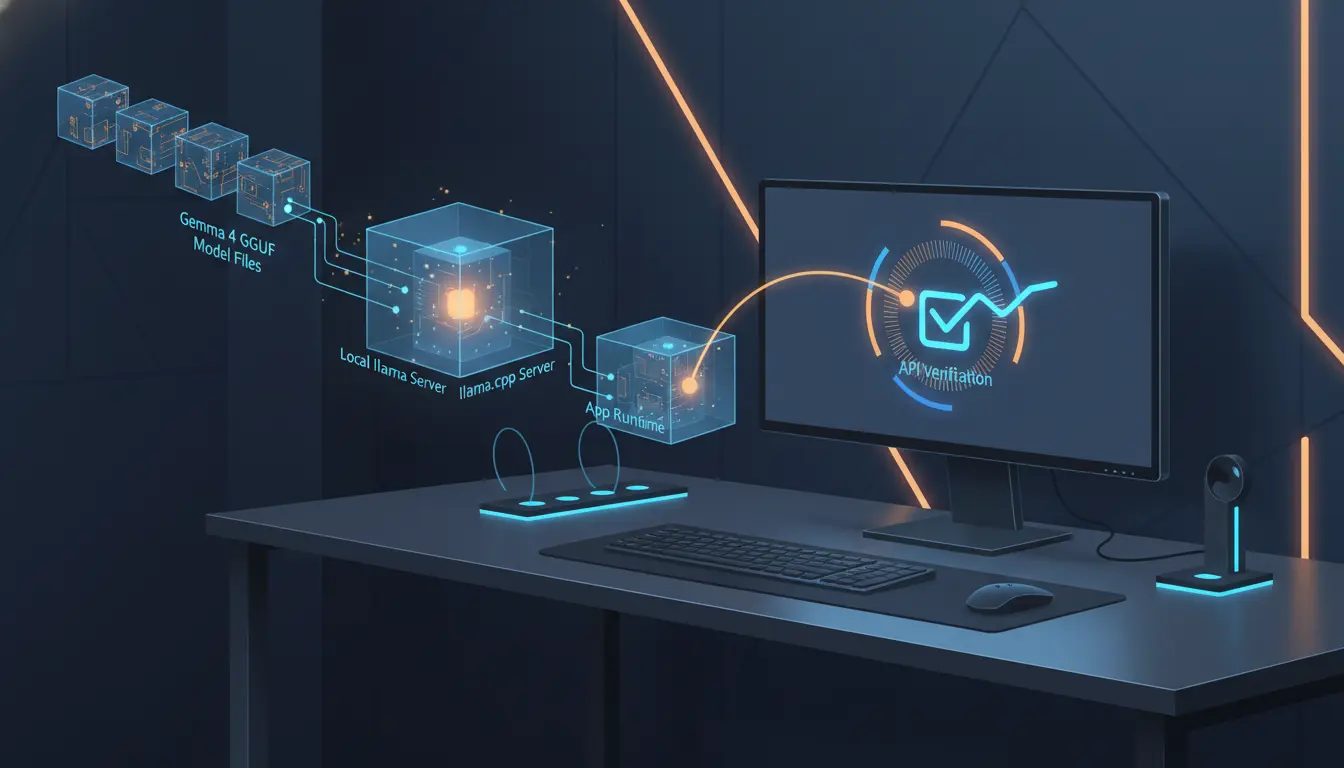

O caminho mais rápido para o Gemma 4 GGUF com llama.cpp

A rota mais rápida no llama.cpp é o modo direto -hf.

Primeiro, instale o llama.cpp:

brew install llama.cpp

Ou no Windows:

winget install llama.cpp

Em seguida, verifique:

llama-cli --version

llama-server --version

Agora, execute o fluxo GGUF mais simples no estilo servidor:

llama-server -hf ggml-org/gemma-4-26B-A4B-it-GGUF

Esse comando permite que o llama.cpp gerencie o download do Gemma 4 e o cache local automaticamente. Se você deseja um endpoint local compatível com a API da OpenAI, este é o caminho mais suave.

Download manual do Gemma 4 com a CLI do Hugging Face

Alguns usuários preferem um arquivo específico e explícito em vez de uma busca automática.

É aqui que os comandos manuais de download do Gemma 4 ajudam:

pip install -U "huggingface_hub[cli]"

huggingface-cli download bartowski/google_gemma-4-31B-it-GGUF \

--include "google_gemma-4-31B-it-Q4_K_M.gguf" \

--local-dir ./

Em seguida, execute-o localmente:

llama-cli -m ./google_gemma-4-31B-it-Q4_K_M.gguf -p "Em uma frase, o que é o Gemma 4?"

Este estilo de configuração é melhor quando você se importa com nomes de arquivos exatos, escolhas de quantização exatas ou scripts de implantação repetíveis.

A maneira mais fácil de baixar o Gemma 4 se você não quiser arquivos manuais

Um fluxo de trabalho manual completo de GGUF nem sempre é a escolha certa para iniciantes.

Se você deseja principalmente uma execução local simples, use o Ollama:

ollama --version

ollama pull gemma4

ollama list

ollama run gemma4 "Dê-me um teste de uma linha."

Você também pode baixar tags específicas de tamanho, como gemma4:e2b, gemma4:e4b, gemma4:26b e gemma4:31b, quando essas tags se adequarem ao seu plano.

Para muitas pessoas, este é um caminho melhor para o primeiro download do Gemma 4 do que um fluxo manual de GGUF, porque o Ollama gerencia o ciclo de vida do modelo local para você.

Como verificar se a sua configuração do Gemma 4 GGUF funcionou

Sua configuração GGUF só está completa quando você verifica o tempo de execução.

Para o modo servidor do llama.cpp:

curl http://localhost:8080/v1/chat/completions \

-H "Content-Type: application/json" \

-H "Authorization: Bearer no-key" \

-d '{

"messages": [

{"role": "system", "content": "Você é um assistente prestativo."},

{"role": "user", "content": "Em uma frase: o que é o Gemma 4?"}

]

}'

Para o Ollama:

curl http://localhost:11434/api/generate -d '{

"model": "gemma4",

"prompt": "Forneça uma saída de teste de uma linha."

}'

Se a sua configuração passou tanto no carregamento do arquivo quanto em uma resposta real ao prompt, você está em uma boa posição para seguir para os testes de tarefas reais.

Problemas comuns com o Gemma 4 GGUF

Um guia inteligente deve alertá-lo sobre os problemas comuns que as pessoas enfrentam na primeira semana.

Problema 1: o modelo carrega mal ou falha em uma interface gráfica (GUI)

Algumas ferramentas GUI ficam atrás do suporte do llama.cpp logo após o lançamento de um novo modelo. Se o seu build GGUF falhar em um aplicativo, teste o mesmo modelo na versão mais recente do llama.cpp antes de assumir que o arquivo está corrompido.

Problema 2: erros de falta de memória (OOM)

Se um build GGUF carregar, mas travar ou rodar mal, a correção geralmente é uma destas:

- Escolha uma quantização menor

- Escolha um modelo menor

- Reduza o uso de contexto

- Pare de assumir que o 31B é o primeiro teste correto

Problema 3: incompatibilidade de modalidade

A família de modelos pode suportar áudio no papel, mas as ferramentas locais podem demorar para implementar esse suporte. Um arquivo GGUF não garante que cada runtime exponha cada modalidade no primeiro dia.

Para onde ir após a configuração do Gemma 4 GGUF

Uma vez que sua configuração GGUF esteja concluída, estes guias são os melhores próximos passos:

- O que é o Gemma 4?

- Review do Gemma 4

- Como rodar o Gemma 4 com o llama.cpp

- Como rodar o Gemma 4 no Ollama

- Requisitos de hardware do Gemma 4

Recomendação final para o download do Gemma 4 GGUF

A recomendação final deste guia é simples: se você quer controle, use a ggml-org ou uma fonte confiável de Gemma 4 no Hugging Face com o llama.cpp; se você quer conveniência, use o Ollama; e se você quer a maior chance de sucesso, comece com algo menor do que você imagina.

Um download de sucesso do Gemma 4 GGUF não se trata de pegar o primeiro arquivo que você vê. Trata-se de escolher a fonte certa, a quantização certa e o runtime certo desde o início.

Guias relacionados

Continue no cluster do Gemma 4 com o proximo guia que combina com a decisao que voce esta tomando agora.

O llama.cpp Suporta o Gemma 4? Status do GGUF, Correções e o que Funciona

Uma resposta prática sobre se o llama.cpp suporta o Gemma 4, com links oficiais do GGUF, status de suporte atual e o que 'suportado' realmente significa.

Como rodar o Gemma 4 com llama.cpp: Configuração de GGUF, Hardware e Guia de Quantização

Tudo o que você precisa para rodar o Gemma 4 localmente com o llama.cpp: tabelas de hardware, comandos de build prontos para copiar e colar, guia de quantização e configuração multimodal.

Guia de API do Gemma 4: Configuração Local Compatível com OpenAI

Use este guia de API do Gemma 4 para criar um endpoint local compatível com a OpenAI, testá-lo rapidamente e escolher o runtime certo para o seu fluxo de trabalho.

Ainda decidindo o que ler depois?

Volte para o hub de guias para navegar por comparacoes de modelos, tutoriais de configuracao e paginas de planejamento de hardware.