Gemma-4-Leitfäden

Gemma-4-GGUF-Download-Leitfaden: Sichere Quellen, Quant-Tipps und lokales Setup

Wenn Sie einen Gemma-4-GGUF-Download brauchen, sind Sie bereits über die Phase „Was ist dieses Modell?“ hinaus. Sie möchten Gemma 4 auf dem sichersten Weg herunterladen, die richtige Quantisierung auswählen und einen lokalen Lauf starten, ohne Stunden zu verschwenden.

Genau dafür ist dieser Leitfaden gemacht. Er behandelt vertrauenswürdige Quellen, wann Sie Gemma-4-Hugging-Face-Repos nutzen sollten, wie Sie GGUF-Builds in llama.cpp ausführen und wann Ollama der einfachere Weg ist.

Gemma-4-GGUF-Download: Beginnen Sie mit der richtigen Datei, nicht mit der größten

Der größte Fehler in jedem GGUF-Workflow ist die Annahme, dass die größte Datei automatisch die beste Datei ist.

Bevor Sie Gemma 4 herunterladen, entscheiden Sie, welches Familienmitglied tatsächlich zu Ihrer Maschine passt:

- E2B, wenn Sie den leichtesten Einstieg brauchen

- E4B, wenn Sie den besten ausgewogenen ersten lokalen Lauf möchten

- 26B A4B, wenn Sie stärkere Ausgabe und Effizienz wollen

- 31B, wenn Sie das höchste dichte High-End-Modell möchten

Wählen Sie dann die Quantisierung anhand des verfügbaren Speichers. Der GGUF-Weg ist nur sinnvoll, wenn die Datei, die Sie wählen, komfortabel auf Ihrer Hardware laufen kann.

Wenn Sie noch Hilfe bei der Modellwahl brauchen, lesen Sie zuerst Was ist Gemma 4?.

Was ist Gemma 4 GGUF?

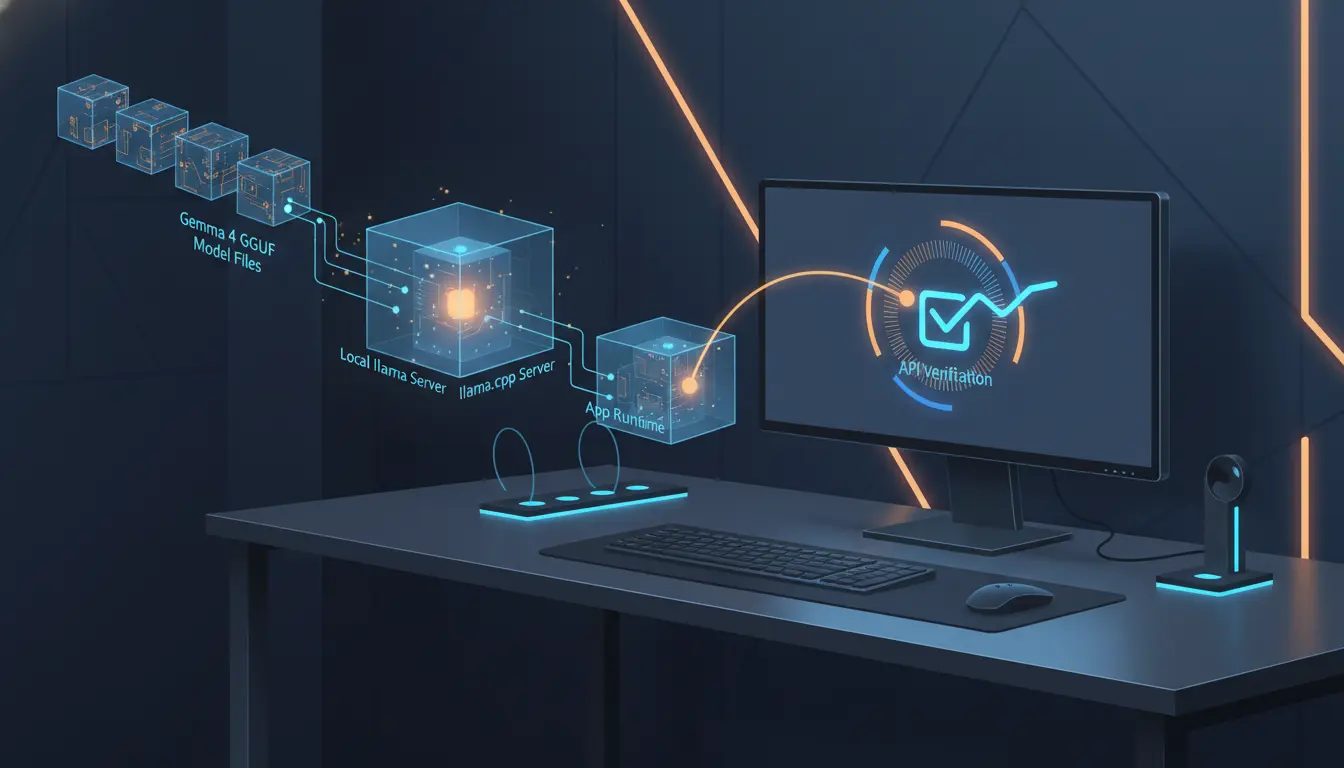

Ein Gemma-4-GGUF-Setup gibt Ihnen ein llama.cpp-freundliches binäres Modellformat, das für effiziente lokale Inferenz und metadatenbewusstes Packaging ausgelegt ist.

In der Praxis ist Gemma 4 GGUF wichtig, weil es das Format ist, das die meisten lokalen Nutzer brauchen, wenn sie:

- llama.cpp-Kompatibilität

- quantisierte Dateien für kleinere Speicherbudgets

- einen direkten Weg zu lokaler CLI- oder lokalem Server-Deployment

Für viele lokale Builder ist Gemma 4 GGUF die praktikabelste Brücke zwischen Modellverfügbarkeit und einem nutzbaren Self-Hosting-Workflow.

Wenn Ihr Ziel lokale Kontrolle ist, ist der GGUF-Weg oft der schnellste Pfad.

Vertrauenswürdige Quellen für den Gemma-4-GGUF-Download

Nicht jede GGUF-Quelle hat das gleiche Vertrauensniveau.

Hier ist die praktische Quellenhierarchie:

| Quelle | Was Sie bekommen | Beste Verwendung |

|---|---|---|

| ggml-org auf Hugging Face | offiziell wirkende GGUF-Repos, abgestimmt auf llama.cpp | beste erste Station für llama.cpp-Nutzer |

| Ollama Library | verwaltete lokale Installation von Gemma-4-Builds | beste erste Station für Einfachheit |

| bartowski auf Hugging Face | viele quantisierte Community-GGUF-Dateien | am besten, wenn Sie mehr Quant-Optionen brauchen |

| Offizielle Google- / Kaggle-Gewichte | Safetensors und First-Party-Kontext | gut für Herkunftsprüfung, nicht für direkten GGUF-Einsatz |

Wenn Ihre Hauptsorge Provenienz ist, starten Sie Ihre Recherche mit den offiziellen Google-Gemma-4-Kanälen und wechseln dann ins vertrauenswürdige llama.cpp-Ökosystem. Wenn Ihnen Bequemlichkeit wichtiger ist, ist Ollama oft die bessere Antwort als ein manueller Gemma-4-Download.

Gemma-4-Hugging-Face-Optionen

Für viele Leser beginnt der praktischste GGUF-Weg bei Gemma 4 auf Hugging Face.

Normalerweise haben Sie dort zwei Wege:

- Sie verwenden ggml-org-Repos für einen direkteren, llama.cpp-freundlichen GGUF-Weg.

- Sie nutzen Community-Quant-Repos wie bartowski, wenn Sie eine bestimmte Datei wie

Q4_K_Mbrauchen.

Genau deshalb ist Gemma 4 Hugging Face ein so wichtiger Begriff für lokales Setup. Es ist nicht nur der Ort zum Stöbern. Es ist der Ort, an dem Sie entscheiden, ob Sie eher First-Party-nahe Ausrichtung oder breitere Community-Quant-Optionen möchten.

Schnellster Gemma-4-GGUF-Weg mit llama.cpp

Der schnellste Weg in llama.cpp ist der direkte -hf-Modus.

Installieren Sie zuerst llama.cpp:

brew install llama.cpp

Oder unter Windows:

winget install llama.cpp

Dann prüfen Sie:

llama-cli --version

llama-server --version

Jetzt starten Sie den einfachsten serverartigen GGUF-Flow:

llama-server -hf ggml-org/gemma-4-26B-A4B-it-GGUF

Damit übernimmt llama.cpp den Gemma-4-Download und den lokalen Cache automatisch. Wenn Sie einen OpenAI-kompatiblen lokalen Endpoint möchten, ist das der glatteste Weg.

Manueller Gemma-4-Download mit Hugging-Face-CLI

Einige Nutzer möchten lieber eine fest angepinnte Datei als einen automatischen Pull.

Dafür helfen manuelle Gemma-4-Download-Befehle:

pip install -U "huggingface_hub[cli]"

huggingface-cli download bartowski/google_gemma-4-31B-it-GGUF \

--include "google_gemma-4-31B-it-Q4_K_M.gguf" \

--local-dir ./

Danach lokal ausführen:

llama-cli -m ./google_gemma-4-31B-it-Q4_K_M.gguf -p "In einem Satz: Was ist Gemma 4?"

Diese Art Setup ist besser, wenn Ihnen exakte Dateinamen, exakte Quant-Wahl oder reproduzierbare Deployment-Skripte wichtig sind.

Einfachster Weg, Gemma 4 herunterzuladen, wenn Sie keine manuellen Dateien möchten

Ein vollständiger manueller GGUF-Workflow ist für Einsteiger nicht immer die richtige Wahl.

Wenn Sie hauptsächlich einen einfachen lokalen Lauf wollen, nutzen Sie Ollama:

ollama --version

ollama pull gemma4

ollama list

ollama run gemma4 "Gib mir einen Einzeilen-Test."

Sie können auch größenbezogene Tags wie gemma4:e2b, gemma4:e4b, gemma4:26b und gemma4:31b ziehen, wenn diese besser zu Ihrem Plan passen.

Für viele Menschen ist das ein besserer erster Gemma-4-Download-Pfad als ein manueller GGUF-Workflow, weil Ollama den lokalen Modell-Lebenszyklus für Sie verwaltet.

So prüfen Sie, ob Ihr Gemma-4-GGUF-Setup funktioniert hat

Ihr GGUF-Setup ist erst abgeschlossen, wenn Sie die Runtime verifiziert haben.

Für den llama.cpp-Servermodus:

curl http://localhost:8080/v1/chat/completions \

-H "Content-Type: application/json" \

-H "Authorization: Bearer no-key" \

-d '{

"messages": [

{"role": "system", "content": "You are a helpful assistant."},

{"role": "user", "content": "In one sentence: what is Gemma 4?"}

]

}'

Für Ollama:

curl http://localhost:11434/api/generate -d '{

"model": "gemma4",

"prompt": "Gib eine Testausgabe in einer Zeile aus."

}'

Wenn Ihr Setup sowohl das Laden der Datei als auch eine echte Prompt-Antwort überstanden hat, sind Sie an einem guten Punkt, um mit echten Aufgaben weiterzumachen.

Häufige Probleme mit Gemma 4 GGUF

Ein guter Leitfaden sollte vor den typischen Problemen der ersten Woche warnen.

Problem 1: Das Modell lädt schlecht oder scheitert in einer GUI

Einige GUI-Tools hängen nach einem neuen Modellrelease der llama.cpp-Unterstützung hinterher. Wenn Ihr GGUF-Build in einer App scheitert, testen Sie dasselbe Modell zuerst in aktuellem llama.cpp, bevor Sie annehmen, dass die Datei kaputt ist.

Problem 2: Out-of-memory-Fehler

Wenn ein GGUF-Build lädt, aber abstürzt oder schlecht läuft, ist die Lösung meist eine davon:

- eine kleinere Quantisierung wählen

- ein kleineres Modell wählen

- die Kontextnutzung senken

- nicht davon ausgehen, dass 31B der richtige erste Test ist

Problem 3: Modalitäts-Mismatch

Die Modellfamilie unterstützt auf dem Papier vielleicht Audio, aber lokale Tools können dieser Unterstützung hinterherhinken. Eine GGUF-Datei garantiert nicht, dass jede Runtime am ersten Tag jede Modalität freischaltet.

Wohin nach Ihrem Gemma-4-GGUF-Setup?

Sobald Ihr GGUF-Setup steht, sind diese Leitfäden die besten nächsten Schritte:

- Was ist Gemma 4?

- Gemma-4-Review

- Wie man Gemma 4 mit llama.cpp ausführt

- Wie man Gemma 4 in Ollama ausführt

- Gemma-4-Hardwareanforderungen

Abschließende Empfehlung zum Gemma-4-GGUF-Download

Die abschließende Empfehlung aus diesem Leitfaden ist einfach: Wenn Sie Kontrolle möchten, nutzen Sie ggml-org oder eine vertrauenswürdige Gemma-4-Hugging-Face-GGUF-Quelle zusammen mit llama.cpp. Wenn Sie Bequemlichkeit möchten, nutzen Sie Ollama. Und wenn Sie die höchste Erfolgschance wollen, beginnen Sie kleiner, als Sie intuitiv denken.

Ein erfolgreicher Gemma-4-GGUF-Download bedeutet nicht, einfach die erste Datei zu greifen, die Sie sehen. Es geht darum, von Anfang an die richtige Quelle, die richtige Quantisierung und die richtige Runtime auszuwählen.

Verwandte Leitfäden

Gehen Sie im Gemma-4-Cluster mit dem nächsten Leitfaden weiter, der zu Ihrer aktuellen Entscheidung passt.

Unterstützt llama.cpp Gemma 4? GGUF-Status, Fixes und was funktioniert

Eine praxisnahe Antwort darauf, ob llama.cpp Gemma 4 unterstützt, mit offiziellen GGUF-Links, aktuellem Support-Status und der Frage, was „unterstützt“ wirklich bedeutet.

Wie man Gemma 4 mit llama.cpp ausführt: GGUF-Setup, Hardware- und Quantisierungsleitfaden

Alles, was Sie brauchen, um Gemma 4 lokal mit llama.cpp auszuführen: Hardwaretabellen, Copy-and-paste-Befehle, Quantisierungsleitfaden und multimodales Setup.

Gemma-4-API-Leitfaden: Lokales OpenAI-kompatibles Setup

Nutzen Sie diesen Gemma-4-API-Leitfaden, um einen lokalen OpenAI-kompatiblen Endpoint zu bauen, ihn schnell zu testen und die richtige Runtime für Ihren Workflow zu wählen.

Sie wissen noch nicht, was Sie als Nächstes lesen sollen?

Gehen Sie zurück zum Leitfaden-Hub, um Modellvergleiche, Setup-Anleitungen und Seiten zur Hardware-Planung zu durchsuchen.